| БрМЭЦМі: |

| БОЮФРДздгкcsdnЃЌБОЮФжївЊЯъЯИНщЩмСЫЯъЯИНщЩмelasticsearchЃЌlogstashЃЌkibanaЃЌbeatsЕФЯъЯИЪЙгУЃЌвдМАlogbackЯъЯИХфжУКЭздЖЈвхШежОДЋЪфЁЃ |

|

вЛЁЂELKгІгУГЁОА

дкИДдгЕФЦѓвЕгІгУЗўЮёШКжа,МЧТМШежОЗНЪНЖржжЖрбљЃЌВЂЧвВЛвзЙщЕЕвдМАЬсЙЉШежОМрПиЕФЛњжЦЁЃЮоТлЪЧПЊЗЂШЫдБЛЙЪЧдЫЮЌШЫдБЖМЮоЗЈзМШЗЕФЖЈЮЛЗўЮёЁЂЗўЮёЦїЩЯУцГіЯжЕФжжжжЮЪЬтЃЌвВУЛгаИпаЇЫбЫїШежОФкШнДгЖјПьЫйЖЈЮЛЮЪЬтЕФЗНЪНЁЃвђДЫашвЊвЛИіМЏжаЪНЁЂЖРСЂЕФЁЂЫбМЏЙмРэИїИіЗўЮёКЭЗўЮёЦїЩЯЕФШежОаХЯЂЃЌМЏжаЙмРэЃЌВЂЬсЙЉСМКУЕФUIНчУцНјааЪ§ОнеЙЪОЃЌДІРэЗжЮіЁЃ

ЕУДЫЃКELKЬсЙЉвЛЬзПЊдДЕФНтОіЗНАИЃЌФмИпаЇЁЂМђБуЕФТњзувдЩЯГЁОАЁЃ

ЖўЁЂELKШежОЯЕЭГНщЩм

1ЁЂELKЗжБ№ЪЧElasticsearchЁЂLogstashЁЂKibanaШ§ИіПЊдДПђМмЫѕаДЁЃ

2ЁЂELKОЕфгІгУШчЯТ

ELKОЕфМмЙЙ

ШчЭМ

1.LogstashВПЪ№жСЗўЮёжїЛњЃЌЖдИїИіЗўЮёЕФШежОНјааВЩМЏЁЂЙ§ТЫЁЂЭЦЫЭЁЃ

2.ElasticsearchДцДЂLogstashДЋЫЭЕФНсЙЙЛЏЪ§ОнЃЌЬсЙЉИјKibanaЁЃ

3.KibanaЬсЙЉгУЛЇUIwebвГУцНјааЃЌЪ§ОнеЙЪОКЭЗжЮіаЮГЩЭМБэЕШЁЃ

БИзЂЃКlogs ЗКжИЃЌИїжжШежОЮФМўвдМАШежОаХЯЂЃКwindowsЃЌnegixЃЌtomcatЃЌwebserverЕШЕШЁЃ

3ЁЂELKИФНј

гЩгкLogstashЯћКФзЪдДДѓЃЌЖјЗўЮёЦїзЪдДЯрЕББІЙѓЃЌЫљвдв§НјСэвЛИіЧсСПМЖШежОВЩМЏПђМмBeatsЃЌЦфжаАќКЌвдЯТ6жж

ИФСМELK

4ЁЂНјвЛВНЫМПМ

ДЋЭГwebЯюФПжаЃЌОГЃЪЙгУlog4jвдМАlogbackЃЈадФмИќИпЃЉЕШГЩЪьШежОВхМўНјааШежОЕФМЧТМЃЌЪЧЗёЬсЙЉИќКУЕФНтОіЗНАИЁЃ

ELKЩ§МЖ1.0

ШежОВЩМЏаТдіLogbackжБНгЗЂЫЭШежОЕНLogstashЕФаЮЪНЁЃШчЙћВЩгУДЫЗНЪНЃЌwebЗўЮёПЩМѕЩйВПЗжЩњГЩlogЮФМўХфжУЃЌЬсИпЪЕЪБадКЭШежОЭЦЫЭаЇТЪ

5ЁЂИпВЂЗЂГЁОА

гЩгкlogstashЯћКФадФмЃЌЫљвдИпВЂЗЂГЁОАШнвзгіЕНСїСПЩЯЕФЦПОБЃЌМАЪБЪЙгУlogstashМЏШКвВЪЧШчДЫЃЌЫљвдПЩвдЬэМгжаМфМўНјааШежОЛКДцДІРэЁЃгЩгкlogstashЪ§ОндДОпгаЖржжЗНЪНЃЌЫљгажаМфМўвВПЩвдКмЖрбЁдёЃЌГЃМћЕФгаkafkaЃЌredisЁЃ

ELKЩ§МЖ2.0

host1ЁЂжаМфМўЁЂhost2 ОљЮЊИпПЩгУЗўЮёМЏШК ЮЊМђЕЅЯдЪОЮДЛГі

logbackГіЯжЕФвЕЮёЪ§ОнПЩвдЭЈЙ§аДШыredisЛђепkafkaЕШжаМфМўНјааЛКДцЃЌдйЭЈЙ§КЯРэЯожЦСїСПЗЇжЕЪфЫЭжСlogstashНјааЙ§ТЫ

beats ШчЙћЪЧfilebeatЦфШежОШєЮоЪЕЪБадвЊЧѓЃЌПЩвдЭЈЙ§ПижЦlogЮФМўИќаТЫйЖШЯожЦBeatsДЋЪфШежОСїСП

Ш§ ELKДюНЈЃЈЗЧМЏШКЃЉ

1ЁЂЯТдиELKЃЈБЃГжАцБОвЛжТЃЉЃЁ

ЭЈЙ§rzУќСюЩЯДЋжСcentos7ащФтЛњ

2ЁЂНтбЙ

|

tar -zxvf elasticsearch-6.3.0.tar.gz

tar -zxvf kibana-6.3.0-linux-x86_64.tar.gz

tar -zxvf filebeat-6.3.0-linux-x86_64.tar.gz

tar -zxvf logstash-6.3.0.tar.gz

|

БИзЂ:tarВЛжЇГжжИЖЈНтбЙФПБъФПТМ ПЩвдЭЈЙ§mv УќСюНјааЧЈвЦЁЃБОНЬГЬЧЈвЦжС/homeФПТМЯТ

3ЁЂjavaЛЗОГДюНЈ

ЭЦМіЪЙгУjdk1.8jdkЛЗОГХфжУ

4ЁЂАВзАelasticsearch

аоИФХфжУЮФМў

| vi

/home/elasticsearch-6.3.0/config/elasticsearch.yml |

|

# ---------------------------------- Network

-----------------------------------

#

# Set the bind address to a specific IP (IPv4

or IPv6):

#

network.host: 0.0.0.0 ##ЗўЮёЦїip БОЛњ

#

# Set a custom port for HTTP:

#

http.port: 9200 ##ЗўЮёЖЫПк

#

# For more information, consult the network

module documentation.

#

|

ЦєЖЏelasticsearch

| /home/elasticsearch-6.3.0/bin/elasticsearch

#УќСюДАдЫаа |

| /home/elasticsearch-6.3.0/bin/elasticsearch

-d #КѓЬЈЯпГЬдЫаа |

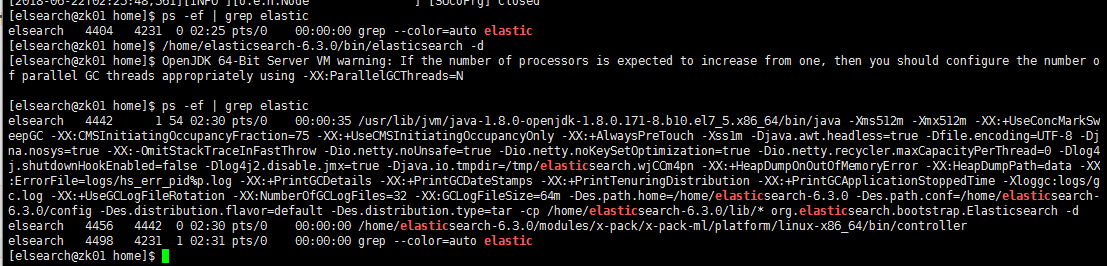

ЙиБеelasticsearch

| ps

-ef | grep elastic #КѓЬЈЯпГЬЙиБе

kill -9 4442 ##pid 4442ЮЊВщДІЯпГЬЕФpid |

бщжЄelasticsearchЦєЖЏ

5ЁЂАВзАkibana

аоИФХфжУЮФМў

| vi

/home/kibana-6.3.0-linux-x86_64/config/kibana.yml |

| server.port:

5601 ##ЗўЮёЖЫПк

server.host: "0.0.0.0" ##ЗўЮёЦїip БОЛњ

elasticsearch.url: "http://localhost:9200"

##elasticsearchЗўЮёЕижЗ гыelasticsearchЖдгІ

|

ЦєЖЏkibana

| /home/kibana-6.3.0-linux-x86_64/bin/kibana

#УќСюДАЦєЖЏ |

| nohup

./kibana-6.3.0-linux-x86_64/bin/kibana &

#КѓЬЈЯпГЬЦєЖЏ |

ЙиБеkibana

| ps

-ef | grep kibana #КѓЬЈЯпГЬЙиБе

kill -9 4525 ##pid 4525 ЮЊВщДІЯпГЬЕФpid |

бщжЄkibanaЦєЖЏ

6ЁЂАВзАlogstash

аТНЈХфжУЮФМў

| vi

/home/logstash-6.3.0/config/logback-es.conf |

|

input {

tcp {

port => 9601

codec => json_lines

}

}

output {

elasticsearch {

hosts => "localhost:9200"

}

stdout { codec => rubydebug}

}

|

БИзЂ:ЩЯЪіЮФМўИДжЦЪББиаыШЅГ§ЖргрПеИёЃЌБЃГжymlЮФМўЙцЗЖЁЃ

БИзЂЃКЩЯЭМгыХфжУВПЗжвЛвЛЖдгІ

| input

{ ##input ЪфШыдДХфжУ

tcp { ##ЪЙгУtcpЪфШыдД ЙйЭјгаЯъЯИЮФЕЕ

port => 9601 ##ЗўЮёЦїМрЬ§ЖЫПк9061 НгЪмШежО ФЌШЯip localhost

codec => json_lines ##ЪЙгУjsonНтЮіШежО ашвЊАВзАjsonНтЮіВхМў

}

}

filter Ѓћ ##Ъ§ОнДІРэ

Ѓ§

output { ##output Ъ§ОнЪфГіХфжУ

elasticsearch { ##ЪЙгУelasticsearchНгЪе

hosts => "localhost:9200" ##МЏШКЕижЗ

ЖрИігУЃЌИєПЊ

}

stdout { codec => rubydebug} ##ЪфГіЕНУќСюДАПк

}

|

logstashЙйЗНЪфШыдДжЇГжвдМАЯТди

АВзАlogstash jsonВхМў

| /home/logstash-6.3.0/bin/logstash-plugin

install logstash-codec-json_lines |

ЦєЖЏlogstash

| /home/logstash-6.3.0/bin/logstash

-f /home/logstash-6.3.0/config/logback-es.conf

##УќСюДАаЮЪН |

| nohup

/home/logstash-6.3.0/bin/logstash -f /home/logstash-6.3.0/config/logback-es.conf

& ##КѓЬЈЯпГЬаЮЪН |

ЙиБеlogstash

| ps

-ef | grep logstash #КѓЬЈЯпГЬЙиБе

kill -9 4617 ##pid 4617 ЮЊВщДІЯпГЬЕФpid |

7 ЪЙгУlogback ДЋЪфШежОЕНlogstash

НЈСЂspringbootЯюФПЃЈЮЊСЫПьЫйЪЙгУЃЉ

pomЮФМўвРРЕ

|

<dependency>

<groupId>net.logstash.logback</groupId>

<artifactId>logstash-logback-encoder</artifactId>

<version>4.11</version>

</dependency>

|

logback.xml

| <?xml

version="1.0" encoding="UTF-8"?>

<!DOCTYPE configuration>

<configuration>

<appender name="LOGSTASH" class="net.logstash.logback.appender.LogstashTcpSocketAppender">

<destination>192.168.253.6:9601</destination>

<!--жИЖЈlogstash ipЃКМрЬ§ЖЫПк tcpAppender ПЩздМКЪЕЯжШчkafkaДЋЪфЕШ-->

<encoder charset="UTF-8" class="net.logstash.logback.encoder.LogstashEncoder"

/>

</appender>

<include resource="org/springframework/boot/logging/logback/base.xml"/>

<!--в§гУspringbootФЌШЯХфжУ-->

<root level="INFO">

<appender-ref ref="LOGSTASH" />

<!--ЪЙгУЩЯЪіЖЉдФlogstashЪ§ОнtcpДЋЪф -->

<appender-ref ref="CONSOLE" />

<!--ЪЙгУspringbootФЌШЯХфжУ ЕїЪдДАПкЪфГі-->

</root>

</configuration>

|

SpringbootLogbackApplication.java ВтЪд

|

package com.zyj;

import org.slf4j.Logger;

import org.slf4j.LoggerFactory;

import org.springframework.boot.SpringApplication;

import org.springframework.boot.autoconfigure.SpringBootApplication;

@SpringBootApplication

public class SpringbootLogbackApplication {

private final static Logger logger = LoggerFactory.getLogger(SpringbootLogbackApplication.class);

public static void main(String[] args) {

new Thread(()->{

for (int i=0;i<100;i++){

logger.info("---test---"+i);

}

}).start();

SpringApplication.run(SpringbootLogbackApplication.class,

args);

}

}

|

9 бщжЄELK

ЮЊбнЪОЗНБуЃЌЮвУЧМђЕЅеЙЪОвЛЯТЃЌЕЅЮЛЪБМфЯпГЬДђгЁФГШежОЕФЫйЖШЁЃжївЊЭЈЙ§kibanaЙ§ТЫГіНсЙЙЛЏЪ§ОнЃЌЭЈЙ§вдЪ§ОнЕФЪБМфДСЮЊxжсЃЌвдcountЭГМЦКЏЪ§ЮЊyжсНјааЭМБэеЙЪОЁЃ

ЃЈ1ЃЉКѓЬЈЦєЖЏelasticsearch ?kibana logstash ВЂбщжЄЦєЖЏГЩЙІ

ЃЈ2ЃЉЦєЖЏspringbootЯюФП

ЃЈ3ЃЉlogstashЪфГіПижЦЬЈМЧТМ ?ДЫЮЊФЌШЯЮоЙ§ТЫЦїДђгЁlogbackАќзАЕФШЋВПаХЯЂ

ЃЈ4ЃЉkibanaШежОЯдЪО

ЬэМгelasticsearchШежОЪ§Он

ЪЙгУЪБМфДСЯдЪО ЕЅЮЛЪБМфЯпГЬМЧТМШежОЪ§СП

ЫФ ЁЂЫМПМЭиеЙ

1ЁЂБОЮФЮДЯъЯИНщЩмlogbackЯъЯИХфжУЃЌвдМАздЖЈвхШежОДЋЪфЃЌНЋКѓајаДШыkafkaвдМАredisЗНАИЃЌlog4jврПЩвдЪЙгУelkвђадФмЮЪЬтВЛзіЩюОПЁЃ

2ЁЂБОЮФЮДЯъЯИНщЩмelasticsearchЃЌlogstashЃЌkibanaЃЌbeatsЕФЯъЯИЪЙгУЃЌНіТоСаМмЙЙвдМАГѕВНelkЪЙгУЁЃbeatsГЃгУЮЊfilebeatЃЌЖдвбОЩњГЩЮФЕЕЕФШежОНјааДЋЪфЁЃ

3ЁЂУЛгаЭъУРЕФМмЙЙЃЌжЛгаКЯЪЪЕФгУЗЈЃЌеыЖдВЛЭЌЕФвЕЮёЛЗОГашвЊЖдМмЙЙНјааЮЂЕїЃЌећЬхЫМТЗВЛБфЁЃelkЮЊЕЅЖРИпПЩгУЗўЮёШКЃЌЗўЮёЦїШКгыbeatsЛђепlogbackврЪЧЖРСЂИпПЩгУЁЃ

4ЁЂИљОнвЕЮёашвЊЃЌдкlogbackДђгЁЕФШежОжаПЩвдНјааНсЙЙЛЏДІРэЃЌврЛђепдкlogstashЕФfilterжаЖдЪ§ОнНјааНсЙЙЛЏДІРэЁЃвЕЮёГЁОАгаД§ПМОПЃЌГѕВНПМТЧвьГЃЗжЮівдМАsqlЛиЙіЕШЁЃ

|