| ����

Linux ��Ⱥ����

�Ӷ��������Ӳ�������������� System x? �� IBM TotalStorage?

ϵͳ������һ�������е� Linux? ��Ⱥ�����ϵ�а���������֣����������еĵ� 2 ���֣�������������ü�Ⱥ�еĹ����������Լ���ΰ�װ�ڵ㡣

���

������ϵ�������еĵ� 2 ���֣���ϵ�к����˰�װ������һ������ Linux

�������Ⱥ��ȫ�����ݡ��й���δӶ��������Ӳ������������һ�������е� Linux(R) ��Ⱥ����Դ�ܶ࣬��ϵ���������Щ�������������Դ�е�������Ϣ���������Թ����ο�����ϵ����������Ϊ���ṩ�й�������һ���µĴ���

Linux ��Ⱥ�Ļ���֪ʶ��Ҫ���һ���Եļܹ������֪ʶ����ο��������ᵽ����زο����Ϻ� Redbooks?��

��ϵ�������ϵͳ�ܹ�ʦ��ϵͳ����ʦʹ�� IBM eServer? Cluster

1350 ��ܣ����ڸÿ�ܵĸ�����Ϣ����μ� �ο����ϣ��ƻ���ʵ�� Linux ��Ⱥ����Ƶġ����е�һ�������ݿ��ܻ��뼯Ⱥ����Ա���ճ���Ⱥ�����йء�

��ϵ�е� �� 1 ���� ��ϸ���������ü�ȺӲ���IJ���ָ������ 2 ���ֽ���������Ӳ�����õĺ������裺��װ�����������л��õ�

IBM systems ����������Cluster Systems Management (CSM) �ͽڵ㰲װ��

��ϵ�еĺ������ֻ�����йؼ�Ⱥ��˴洢�����ݣ������洢Ӳ�����ú� IBM

�����ļ�ϵͳ General Parallel File System (GPFS) �İ�װ�����á�

���ù���������

���ü�Ⱥ��������Ҫ�����Σ����ȣ����ձ�ϵ�е� 1 ����������װ��Ⱥ������������Ȼ��װ��Ⱥ��ʣ�ಿ�֣���

����װ�ڵ㡱 һ����ʾ����ѭ�����IJ�����в�����������ʹ�ù������������������ü�Ⱥ��ʣ�ಿ�֣����һ�dz������ڰ�װ���ά���Ͳ�����

��װ Linux

�ڹ����������ϰ�װȫ�µIJ���ϵͳ��ȷ�����������������������á�����ʹ�õ���

System x 346 ������һ����͵� IBM �������������������� Red Hat Enterprise

Linux (RHEL) 3����Ȼ��Ҳ����ʹ���������� Linux �汾������ Suse Linux Enterprise

Server (SLES)���������������System x 346 ���� 64 λ��������������װ�IJ���ϵͳ��

RHEL 3 �� x86_64 �ܹ������� ServeRAID 7k ����˫���̾���Ȼ�����Ļ���������֮��ͬ������װ

CSM �����������Ļ�������Ӧ�ô�����֮���ơ�

�����µ� IBM ServeRAID ֧�� CD ������������Ϊ RAID

1���������ð��ش��̣�ǰ���Ƿ��������������������̣�������ҪΪ����ϵͳ���ô��̹��ϱ�����

����������Ϊ��һ����֮���õ�һ�� RHEL CD ��������������װ RHEL

����ϵͳ�����ݿ���̨�IJ�ͬ����������Ҫ���İ�װ����ۡ����磬����һ���ͷֱ��ʵĿ���̨����������Ҫͨ����������ʾ�������

linux vga=normal ������ CD�������� Linux ��װ GUI ʱ���밴������ָ���������а�װ��

1.ѡ�����ԡ�����ͼ��������͵ȡ�

2.���ô��̷�����������ʾ��

128Mb /boot ��������

2GB ����������

��ʣ��ռ����� LVM �����Ҳ����и�ʽ��

3.ִ������ (LVM) ���ã�������ʾ��

��������ϵͳ��

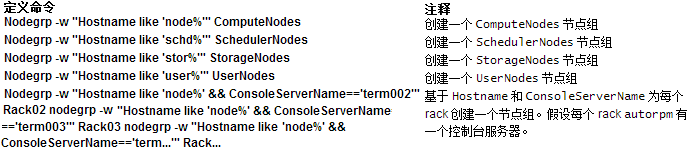

������������ �� 1 ��ʾ��

4.��������ӿڣ�������ʾ��

�������ϵ�ʾ�������ļ������� boot �Ͼ��й̶� IP ��ַ 192.168.0.253/24

�� eth0 ��

������������Ϊ mgmt001.cluster.com.��

�ڴ˽Σ�����Ҫ��������/DNS ��������ⲿ IP ��Ϣ�������ڰ�װ�������ٶ���������á�

5.������ǽ����Ϊ no firewall �������������ӡ������Ҫ IP

���������ں����֮�������á�

6.Ӧ�ñ������ã�ѡ����ʵ�ʱ����

7.���� root ���룻�����е������� cluster��

8.���ư�װ��ʹ֮�����������ݣ�

X Window ϵͳ

KDE������K ���滷����

Graphical internet

���������ù���

FTP ������

���������

������������

��������

9.��ʼ��װ��

�� 1. ��������

��װ��ɺ���Ҫ��һ�������а�װ���������Ļ��������Լ��Ļ����Թ������������а�װ��Ķ��ơ����磬��������Ҫ����

X ������ʹ֮�ʺ����Լ��� KVM�����̡���Ƶ����꣩���á�

��װ CSM

��֧��ϵͳ�ϰ�װ Cluster Systems Management

(CSM) �����ܵ���˵���ٱȽϼ��� IBM Linux ��Ⱥ�ĵ��⣨�μ� �ο����ϣ������ҵ� HTML

��ʽ�� PDF ��ʽ������ĵ���

��һ���ǽ��������Ƶ���������������Ϊ����Ҫ�� root �û�����ִ�а�װ�����Կ��Խ���洢��

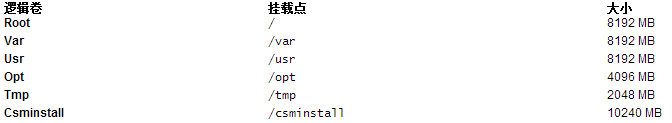

root ��Ŀ¼���� 2 ������һ�ֺ��ʵ�Ŀ¼�ṹ��

�� 2. CSM ����

Ҫ��װ CSM���谲װ csm.core i386 RPM �����ð�Ҳ������

the x86_64 �ܹ�����װ��ð�֮�Ϳ���װ CSM �����������ˡ����ȣ��� /etc/profile.d/Csm.sh

���뵽��ǰ�� shell ������µ�·�����á�Ȼ������ installms ����� CSM ����֤Ӧ�õ�ϵͳ����������Ҫ��������

rpm -ivh /root/csm/csm.core*.i386.rpm

. /etc/profile.d/Csm.sh

installms -p /root/csm/downloads:/root/csm

csmconfig -L <Your License File> |

ע�⣺���û�� CSM ����֤�ļ���ͬ���������� csmconfig -L

������� 60 �����������֤��60 ��������ڹ���������ҪӦ����ʽ�� CSM ����֤�Լ��� CSM

���ܡ�

��Դ��ͼ�Ⱥ�����Ż�

CSM �����;��п������ԡ�Red Hat Linux �������������Ҳ�ܺܺõ�������������Ϊ���ô��͵ļ�Ⱥ������˳�����У�������Ҫ�Թ�������������һЩ�Ż��������о����Ż�������һЩ������

�������ض��ӿ��ϵ� DHCP ����

�༭ /etc/sysconfig/dhcpd DHCPD �����ļ���ʹ

DHCPDARGS ����Ϊ���ʵĽӿڡ����� DHCPDARGS ������ Red Hat Linux ��

/etc/init.d/dhcpd DHCPD �����ű��У��������������ض������� DHCP �ػ�����Ϊ���ܹ���

eth0 ��������ȷ������������Ѱ���������֮�ڣ�������ʾ��

���� ARP ����С�ͳ�ʱ���á�

���һ���ܴ�������ͬһ�������Ͼ��кܶ��ȫ����Ⱥ��ARP ���Ϳ��ܻ���أ��ͻ����˾���

CSM �������������Ӧ�ٶ�̫����Ϊ�˱�������������Ҫ�������е�ϵͳ�����¸��ģ�������Щ�������ӵ� /etc/sysctl.conf

�ļ�����ʹ�����ܹ��־���Ч��

net.ipv4.conf.all.arp_filter = 1

net.ipv4.conf.all.rp_filter = 1

net.ipv4.neigh.default.gc_thresh1 = 512

net.ipv4.neigh.default.gc_thresh2 = 2048

net.ipv4.neigh.default.gc_thresh3 = 4096

net.ipv4.neigh.default.gc_stale_time = 240 |

���� NFS �ػ������������

Ĭ�ϵأ����� CSM �ȳ�ֵΪ 16������ζ�ſ缯Ⱥ���е������һ������

16 ���ڵ㣬�ڵ㰲װҲ����ˡ�Red Hat Linux �ı� NFS ������ 8 ����ͬʱ���е��ػ�������������չ

NFS������������ NFSD �߳����� 16 ��ƥ��Ĭ�ϵ� CSM �ȳ�ֵ����������ȳ�ֵ��������Ҳ��������

NFS ���߳�����һ��أ��ȳ�ֵΪ 32��NFS �߳���Ϊ 32 ���ڱ�֤�ٶȺͿɿ����Ѿ��㹻�����һ�������ͬʱ��װ��

32 �ڵ�ĵ��� rack��Ҫʵ����һĿ�ģ����������ļ� /etc/sysconfig/nfs �����������У�

���� NTP ��������

Ĭ�ϵ� Red Hat Linux ����Ӧ��Ҳ������ NTP ����������

/etc/ntp.conf NTP �����ļ�����һ����������������Ⱥ�����ϵĽڵ��ܹ��������������ʱ��ͬ����������ʾ��

restrict 192.168.0.253 mask 255.255.255.0 notrust nomodify notrap |

��������������ܹ�����һ���ⲿ��ʱ�ӷ�������ͨ����������һ�������ù�����������ʱ��������ⲿʱ�ӷ�����ͬ����

ͨ������ָ��ȷ�� NTP �����������в���������ʱ�Զ�������

chkconfig ntpd on

service ntpd start |

��װ�ڵ�

������е����ú����ò���֮��CSM �����������Ͱ�װ����ˡ��ڰ�װ�ڵ�֮ǰ����Ҫ��

CSM ���������������һЩ���������������ڵ㰲װ�ķ�ʽ���� CSM ������������ִ�б�����ʾ�İ�װ���衣

����ڵ�

���Բο��йض���ڵ��ֲ�ҳ������ڵ㡣����������ڵ��һ�ָ�Ϊ�ķ�����ͨ���ڵ㶨���ļ��������������ȴ���һ��

stanza �ļ���Ȼ������Ϊ�������ݸ� CSM �����������г��Ľڵ㡣���� stanza �ļ������ס�

�嵥 1 ������һ����̵�ʾ���ڵ㶨���ļ�����������ڵ������֮��ͬ�����ԣ�������Ĭ��

stanza �ļ��Ķ����������ǡ�֮��ÿ�� stanza ��Ӧ�ô���һ���ڵ������¸��ض��ڽڵ�����ԡ����������ʾ��Ӧ����ζ���ʾ����Ⱥ�е�����������

���� ��������ڵ㣬һ���洢��������

�嵥 1. ʾ���ڵ㶨���ļ�

default:

ConsoleMethod = mrv

ConsoleSerialDevice = ttyS0

ConsoleSerialSpeed = 9600

InstallAdapterName = eth0

InstallCSMVersion = 1.4.1

InstallMethod = kickstart

InstallOSName = Linux

InstallPkgArchitecture = x86_64

ManagementServer = mgmt001.cluster.com

PowerMethod = bmc

node001.cluster.com:

ConsolePortNum = 1

ConsoleServerName = term002

HWControlNodeId = node001

HWControlPoint = node001_d.cluster.com

InstallDistributionName = RedHatEL-WS

InstallDistributionVersion = 4

InstallServiceLevel = QU1

node002.cluster.com:

ConsolePortNum = 2

ConsoleServerName = term002

HWControlNodeId = node002

HWControlPoint = node002_d.cluster.com

InstallDistributionName = RedHatEL-WS

InstallDistributionVersion = 4

InstallServiceLevel = QU1

stor001.cluster.com:

ConsolePortNum = 2

ConsoleServerName = term001

HWControlNodeId = stor001

HWControlPoint = stor001_d.cluster.com

InstallDistributionName = RedHatEL-AS

InstallDistributionVersion = 3

InstallServiceLevel = QU5 |

���ڴ��ͼ�Ⱥ��˵���ڵ㶨���ļ��Ľű�Ҫ�ȱ����е�����ű����ܶࡣ���������������ݸ� CSM �������Էdz�Ѹ�ٵش����ڵ㣺

definenode -f <node-def-filename> |

ע�� node-def-filename �ɱ���Ϊ�������д洢�ڵ㶨���ļ����ļ��������磬definenode

-f //tmp/my_nodes.def��

CSM �ڵ����ݿ�����Ӧ�ð������нڵ㡣���ڱ��������С�͵ļ�Ⱥ��˵���ڵ����ݿ�Ӧ�ð���

16 ������ڵ㡢1 ���û��ڵ㡢1 ���������ڵ�� 1 ���洢��������CSM �������������������� CSM

���ݿ��ڡ�����ͨ�� lsnodes ����鿴�ڵ��б���������ʹ�� lsnode -F �������鿴������ϸ���б������б�����������

CSM �ڵ㶨�塣����������������ض���һ���ļ������Ϳ���ʹ�� definenode -f ���������¶���ڵ��ˡ�

����ڵ���

CSM ����ͨ��һЩ�������Խڵ���з��飬�������Ժ�Ϳ������ijһ��ڵ�Ӧ��

CSM �����ˡ�������Ҫ���þ�����ͬ���Ե�ͬ��ڵ�������˵����һ�㽫�dz����á�

CSM ��֧�ֶ�̬�ڵ�����֧�־�̬�ڵ��顣��̬�ڵ�������ڵ�����һ���̶��б������б����ɹ���Ա�ֶ�ά�������磬ʹ�þ�̬�ڵ��飬�������ֶ����¶���Ľڵ����ӵ���Ӧ�Ľڵ����С��ڴ��ͼ�Ⱥ�У���̬�ڵ����Ϊ��������������ܱ��ܺõ����û��ܽ�ʡ����ʱ��ͼ������������ڵ����롣��̬�ڵ��鶨����������һ���ڵ��б������б��еij�Ա���ض����������壬�������һ���ڵ㣨�����¶���Ľڵ㣩����������������������ͻᱻ�Զ��ŵ���Ӧ�Ľڵ��顣��

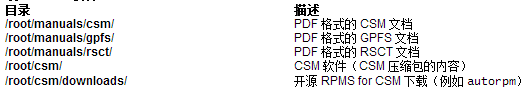

3 ������һЩ��̬�ڵ���Ķ��塣

�� 3: ��̬�ڵ���

�� Linux ������

CSM ����������Ӧ�ð�����Ҫ�缯Ⱥ��װ������ Linux ������� CD

�ϵ�ȫ�����ݡ���ҲӦ��Ϊ�ڿͻ����Ͻ��� CSM ��װ���������������κΰ�װ����֮ǰ������Ҫ���ġ�CSM

Ϊ���ṩ���������������Ϊÿ��Ҫ��װ�� Linux �����涼Ҫ�������������

Ҫ������� CSM ������ /csminstall/Linux ������������

copycsmpkgs ������磺

copycsmpkgs -p /path/to/csm:/path/to/downloads InstallDistributionName=RedHatEL-WS

InstallDistributionVersion=4 InstallServiceLevel=QU1

copycsmpkgs -p /path/to/csm:/path/to/downloads InstallDistributionName=RedHatEL-AS

InstallDistributionVersion=3 InstallServiceLevel=QU5 |

Ҫ������� Linux ������ CD �� /csminstall/Linux ������������ copycds

������磺

copycds InstallDistributionName=RedHatEL-WS InstallDistributionVersion=4

InstallServiceLevel=QU1

copycds InstallDistributionName=RedHatEL-AS InstallDistributionVersion=3

InstallServiceLevel=QU5 |

һ��Ϊ��Щ CD ���ú�Ŀ¼�ṹ����������������Ķ��ư�����ϵͳ��װ�����н��а�װ����£����磺

Copy to /csminstall/Linux/.../x86_64/install

to ensure they are installed.

Copy to /csminstall/Linux/.../x86_64/updates

to install only if an existing version is present.

�����ýڵ�����������Ŀ¼�Ա����ض��ڵ�����ֻ��װ����� RPMS�������Ҫ��ô���Ļ�����

���� CFM

CSM ���г�Ϊ Configuration File Manager

(CFM) �Ļ��ƣ����������缯Ⱥ�ֲ��ļ���ʹ�� CFM ���Կ缯Ⱥ������ͬ���ļ�������ڽڵ㰲װ֮ǰ���������ã��ļ��ͻ��ڰ�װ�����б��ַ���

CFM �������������������ϵ�����Ŀ¼�е��ļ������ӡ���Щ�����ڱ����͵��ڵ�ʱ�Ǹ�������Ķ����DZ����ƹ����ġ���һ�����

hosts ֮����ļ��dz����ã�������ʾ��

mkdir /cfmroot/etc

ln -s /etc/hosts /cfmroot/etc/hosts |

���������ļ��⣬�����Ը����ļ��� CFM�����磺

1.����Ĭ�ϵ� NTP �����ļ��� /cfmroot/ntp.conf

2.Ϊ�������������ӷ������У�������ʾ��

/cfmroot/etc/ntp

echo "management.server.full.name" gt; /cfmroot/etc/ntp/step-tickers |

�ļ�����缯Ⱥ�ַ���

����Ҫ�������ļ����͵���Ⱥ�ϵ��ض��ص�ʱ������ʹ�� CFM���������Ҫ�ַ����ͼ�Ⱥ�ϵĴ����ļ�����ò�Ҫʹ��

CFM �����磬��Ҫʹ�� CFM ����һ�� tar �鵵�ļ���װ���������������ڴ��ͼ�ȺӲҪʹ�� CFM��CFM

�Ứ�ܳ���ʱ�����У�ʹ֮�쳣���á�����ؼ������֧�ֵİ�װ��������װ���������磬ʹ�� RPM ���� tar

�ļ�����װ������ֻ���������ļ�������Щ�ܿ��ܻ���ʱ������ĵ��ļ����� CFM��

���ƽڵ㹹��

�������ƻ���װ��ÿ���ڵ�IJ���ϵͳ��˵��CSM ���е������簲װ���ƵĽӿڣ�����

NIM on AIX?��autoYaST on Suse Linux �� kickstart on Red

Hat Linux�������� Red Hat Ϊ��˵�����ʹ�� kickstart �� kickstart

�����ļ����нڵ㰲װ��

�ڿ�ʼ���� kickstart ֮ǰ����Ҫ������Ƿ�ӵ�ж����нڵ�� rpower

����Ȩ���������� CSM ��ü������ UUID���������ڸ��µ� CSM �汾�С���� UUID �����ã�����

CSM �汾���� 1.4.1.3��CSM �ͻ᳢�Դӽڵ�ĵ�һ�� Ethernet �豸��� MAC ��ַ��Ϊ��ʹ

CSM MAC ��ַ�ռ����ã��ն˷��������ñ���ƥ��ڵ� BIOS �е����á�ʹ�� rconsole ����ɼ���ն˷��������ӡ����ɹ�������

rpower ���ƺ��ն˷��������ӣ�������ʵĻ�����֮�Ϳ��Լ��� kickstart �����ˡ�

CSM ���ļ� /opt/csm/install/kscfg.tmpl.*

���ṩ��Ĭ�ϵ� kickstart ģ�塣�����Ҫ�Ļ������Խ���Щģ�帴�Ƶ���ͬ���ļ������Զ����Ը��õ��������Լ��Ļ���Ҫ����Щģ����һ���ܺõ���㣬һ����˵������Ӧ�ò�ȡ����Щģ���ļ����ж��Ƶķ�ʽ������ʹ���κ�������

kickstart �ļ���ԭ������Щģ��������� CSM ��������������һ����װ��ű����ĺꡣCSM ͨ�����������յ�

kickstart �ļ����ڵ�ʹ��֮ǰ���ȷ��� kickstart ģ���ļ�������� kickstart

���̷dz��а��������յ��ļ��������н������ĺ겢�������ģ���ڶ����һ�����ݵ�ȫ���ű���

ͨ��������ͨ�����·�ʽ��ģ����и��ģ�

1.���Ĵ��̷�����������Ҫ���� LVM

2.�ı�Ĭ������

3.�༭Ҫ����װ�İ��б�

�༭�� kickstart ģ��֮������ CSM setup �������������յ�

kickstart �ļ�������������ʾ��������� UUID �� MAC ��ַ�ռ���

csmsetupks -n node001 -k /opt/csm/install/your.kickstart.file -x |

ע�⣺��Ҫʹ�� -x ���أ���Ϊ��ǰ������ copycds ���

������������

��ʹ�ڼ�Ⱥ�а�װ�˲���ϵͳ����ֱ��֧�ֵ�Ӳ����Ҳ��Ȼ���ܻ�����Ӧ�������������ʹ�á��ڱ�Ҫ��ʱ���������Ҳ����������������¡�������հ�װ�Ͱ�װ����ϵͳʱ���õ�

RAM ������Ҫ������������CSM �����Զ������ӻ��滻�������������������

��ʹ�� System x Ӳ��������ʱ����ͨ����ϣ����ð��� Broadcom

Ethernethard �������� Broadcom ���������������ṩ�����ܺ��ȶ��ԡ�Ҫʵ����һĿ�ģ��ɰ����²����������Щ����ʹ�õ���

Broadcom bcm5700 ������������� Red Hat Linux �ṩ�ı��� tg3 ������������

��Ϊ��������һ���ں�ģ�飬����Ҫȷ�����Ŀ��ϵͳ��װ���ں�Դƥ���ں˵ȼ������ͣ�UP

�� SMP����

�� Broadcom ���ο� �ο����ϣ��������µ� bcm57xx �����������������Դ���롣

�ӽ����� bcm ��������� src Ŀ¼���� make ����Ե�ǰ�������ں˽��й�����

�������������� ��bcm5700.ko for 2.6 kernel ��

bcm5700.o for 2.4 kernels�����Ƶ������������ϵ�

/csminstall/csm/drivers/lt;kernel versiongt;/x86_64��

�������������ں˰汾���й������������� make clean �������ǰ�Ĺ�����Ȼ��������

make LINUX=/path/to/your/kernel/source��

CSM �ڹ��� RAM ����ӳ��ʱ��ʹ��Ŀ¼�ṹ /csminstall/csm/drivers/lt;kernel

versiongt;/lt;architecturegt ֮�µ����������ں˰汾ƥ�� RAM �����ں˰汾ʱ����Щӳ�������ڰ�װ����������ϵͳ��ע�Ϊ��װӳ����������ʱһ��ҪС�ģ���װ�ں˵��ں˰汾�ſ��ܻһ��������

Red Hat ͨ�����ڰ汾�ַ���β���ӵ��� BOOT������ں˰汾������װϵͳ�������ں���ƥ�䣬��������Ե�ǰ�IJ���ϵͳҲ���á����������ȷ���ں˵İ汾��������

RAM ����ӳ���ڽ�һ�������о���������һ��������

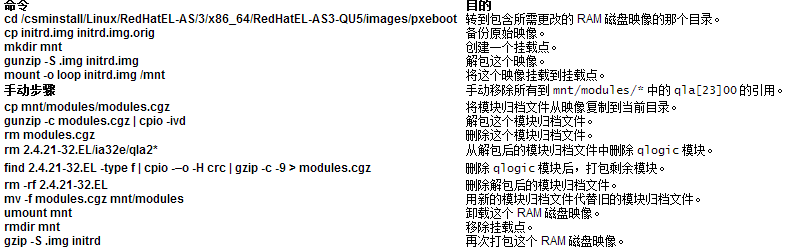

�� RAM ����

ͨ������һ���費�Ƽ�ʹ�á�����ʱ���ֲ��ò���ô�������粻��ȷ���ں˰汾������������ڸ���Ӧ�ó���������������Ҫ�����о�

RAM ����ӳ��ʱ�������������а�����

��ʹ���������������� (HBA) ���洢ֱ�ӱ����� Red Hat Linux

ϵͳʱ���洢������������ qlogic qla2300 ���������ܻ��� ServeRAID �������������ڲ�ϵͳ���̼�����ϵͳ���̣�֮ǰ���ء����������������ζ�Ű�װ�ڴ���Ĵ������ˡ�/dev/sda

�������Ǹ��Ӵ洢���ʶ��DZ��ش����ϵ� LUN������������£��ڰ�װ�µIJ���ϵͳʱ������д SAN �϶��DZ��ش����ϵ�����Ҫ����С�ġ�Ϊ�����䷢�������

CSM ������������ӳ���Ĭ�� Red Hat RAM �������Ƴ� qlogic ��������Ȼ��ϵͳ����ʱҲ��Ҫ��������������ʹ������һ�ֻ��ƣ�����

post ��װ�ű���Ϊ�����еIJ���ϵͳ��װ������������Ĭ�� Red Hat qlogic ��������ͨ�������ǹ���ת���������������Ƽ���������������

���磬�� Red Hat Enterprise Linux Advanced

Server Version 3 ��Ĭ�� RAM ����ӳ���Ƴ� qla2300 �������� 4 ��������ʵ�ִ�Ŀ�ĵ����

�� 4: RAM ��������

ע�⣺Ҫ�� Suse �� SLES �� RAM ���̣�����ȷ�� ips��ServeRAID

������������ INITRD_MODULES stanza ֮�µ� /etc/sysconfig/kernel

�ļ��ڵ����� HBA ��������֮ǰ�����ڴ��� RAM ����ӳ��� Suse �� SLES ���ƿ�ȷ����������˳����ء�

��װ��������ǰ������������ű�

����ÿ�������ͼ�Ⱥ���Dz���ͬ�ģ���������ҪӦ��һЩ��װ��ű����������Լ����ض������Ʋ���ϵͳ��װ�������������������°�װ��ϵͳ֮ǰ��֮�������Щ�������������ñ���������������˵����ʮ�����ã�CSM

��Դ�Ŀ���ṩ��һ��ʾ���ű�������˫�������ã���ÿ���ڵ㶼��һ�����������һ���洢���磩��ԭ�����ʾ����Ⱥ����Ҫʹ�ñ������������á�����IJ���������ʾ��

1.�� CSM �ṩ��Ĭ�����������ýű����Ƶ� installprereboot

�ű�ִ��Ŀ¼��ʹ�ű������ڰ�װʱ���У�ȷ���������У�������ʾ��

cp /csminstall/csm/scripts/adaptor_config_Linux /csminstall/csm/scripts/

installprereboot/100_adapter_config._LinuxNodes

chmod 755 /csminstall/csm/scripts/installprereboot/100_adaptor_config._LinuxNodes |

2.���������� stanza �ļ� /csminstall/csm/scripts/data/Linux_adapter_stanza_file����������ʾ��дͷ����

default:

machine_type=secondary

network_type=eth

interface_name=eth1

DEVICE=eth1

STARTMODE=onboot

ONBOOT=yes

BROADCAST=192.168.1.255

NETMASK=255.255.255.0

MTU=9000 |

3.����������б��� (eth1) ������������ʱ��������������Թ㲥��ַ�����������

MTU ��С��Ĭ�����á��ڸ��ӵ� stanza ���ڻ�������һ����ڵ㶨���ļ���ͬ�ķ�ʽ�����ض��ڼ����������ϸ�ڣ�������ʾ��

for node in $(lsnodes)

do

ip=$(grep $node /etc/hosts | head -n 1 | awk '{print $1}')

echo -e "$node:\n IPADDR=$ip" gt;gt; Linux_adaptor_stanza_file

done |

4.��������ӵ������� stanza �ļ���Ϊÿ����������ò�ͬ��

IP ��ַ��������ʾ��

node001.cluster.com:

IPADDR: 192.168.1.1

node002.cluster.com:

IPADDR: 192.168.1.2

node003.cluster.com:

IPADDR: 192.168.1.3 |

��װ

�ڽڵ㰲װ��������������Ҫ�� shell ����������CSM_FANOUT

�� CSM_FANOUT_DELAY��ǰһ��������������ٽڵ�ͬʱ���� CSM ָ������ж��ٽڵ�ӹ�����������������������һ����������������������һ��Ҫ��װ�Ľڵ�ʱ

CSM Ҫ�ȴ��ʱ�䣨����Ϊ��λ�������������������÷ֱ�Ϊ 16 ���ڵ������ȳ���������������һ��ڵ�֮ǰҪ�ȴ�

20 ���ӡ���ЩĬ��ֵ���ڴ������װ��˵�ǿ��Խ��ܵģ���Ҳ������Դ��ͼ�Ⱥ�������ӡ�

Ҫ�Դ�ͳ��ʽ��װ��Ⱥ����������²��裺

1.���ô˰�װ����������ʾ��װ����ڵ㣺

csmsetupks -N ComputeNodes -k

/opt/csm/install/your.kickstart.file.nodes -x

installnode -N ComputeNodes |

2.���ô˰�װ����������ʾ��װ�û��ڵ㣺

csmsetupks -N UserNodes -k /opt/csm/install/your.kickstart.file.user -x

installnode -N UserNodes |

3.���ô˰�װ����������ʾ��װ�������ڵ㣺

csmsetupks -N SchedulerNodes -k

/opt/csm/install/your.kickstart.file.schd -x

installnode -N SchedulerNodes |

4.���ô˰�װ����������ʾ��װ�洢�ڵ㣺

csmsetupks -N StorageNodes -k

/opt/csm/install/your.kickstart.file.stor -x

installnode -N StorageNodes |

���ڴ��ͼ�Ⱥ�İ�װ����Ҫʹ�ð�װ�����������зֽΰ�װ������������ʾʹ��װ���̲��н��У�

1.�� CSM ������ InstallServer ���ԡ�����ÿһ����Ӱ�װ��������װ�Ľڵ㣬��

InstallServer ��������Ϊ�ýڵ���ʹ�õİ�װ�������������������û��������һ���ԣ��ͻ�ʹ����Ĭ��ֵ���������Ĺ�����������װ���ڴ��ͼ�Ⱥ�������ȷ�˵��ÿ��

rack �� 32 ���ڵ㣬����ѡ��ÿ�� rack �ײ��Ľڵ���Ϊ�˼�Ⱥ�İ�װ���������ڱ����У�Ҫ�� rack

1 �е� node002 �� node032 ���óɴ� node001 ��װ���� node001 �ӹ�����������װ������ʹ���������

chnode -n node002-node032 InstallServer=node001 |

2.��������ʾ����һ���������а�װ�������Ķ�̬�ڵ����һ�������ͻ����Ķ�̬�ڵ��飺

nodegrp -w "InstallServer like '_%'" InstallServers

nodegrp -w "InstallServer not like '_%'" InstallClients |

3.���ô˰�װ����������ʾ��װ��װ��������

csmsetupks -N InstallServers -x

installnode -N InstallServers |

4.Ҫ������ð�װ�������ṩ�Ĵ����������� CSM �ȳ�ֵ��ͬʱ������������ڵ㡣�����ÿ��

rack 32 �ڵ�������У�CSM ������ȳ�ֵӦ���� 32 ����װ������������������ÿ�� rack

һ���ڵ������£����� rack �����������ڱ����У���Ҳ���Խ�ÿ����װ�������ϵ� NFS �߳������ӵ�

32 �����õ���չ NFS��ʹ�����ַ�����������ͬʱ��װ�ɰ���ǧ̨������

5.���ô˰�װ����������ʾ��װ��װ�ͻ�����

csmsetupks -N InstallClients -x

installnode -N InstallClients |

������

��ɱ�ϵ��ǰ�������ָ��������в���֮����������˼�Ⱥ��Ӳ�����������ã���������ϵͳ���������ͽڵ㰲װ����ϵ�еĺ������ֽ������������ú�˴洢��ȫ���̣�������˵������ִ�д洢Ӳ�������Լ���װ������

IBM �����ļ�ϵͳ General Parallel File System (GPFS)��

|