| БрМЭЦМі: |

| БОЮФРДздгкcnblogsЃЌЮФеТжївЊНщЩмСЫOpenMPбЛЗЕФВЂааЛЏЃЌЙмРэЙЋгаКЭЫНгаЪ§ОнвдМАИКдиОљКтЪЙЕШЯрЙижЊЪЖЁЃ |

|

ЧАСНЬь(ЦфЪЕЪЧМИИідТвдЧАСЫ)ПДЕНСЫДњТыжага #pragma omp

parallel for вЛЖЮЃЌИаОѕКУЯёЪЧ OpenMPЃЌвдЧАПДЕНВЂааЛЏЕФЖЋЮїЖМЪЧжБНгЖуПЊЃЌМШШЛЖуВЛПЊСЫЃЌВЛЗСбаОПвЛЯТЃК

OpenMP ЪЧ Open MultiProcessing ЕФЫѕаДЁЃOpenMP ВЂВЛЪЧвЛИіМђЕЅЕФКЏЪ§ПтЃЌЖјЪЧвЛИіжюЖрБрвыЦїжЇГжЕФПђМмЃЌЛђепЫЕЪЧавщАЩЃЌзмжЎЃЌВЛашвЊШЮКЮХфжУЃЌФуОЭПЩвддк

Visual Studio Лђеп gcc жаЪЙгУЫќСЫЁЃ

ЮвУЧОЭЗжШ§ВПЗжРДНщЩмАЩЃЌвђЮЊЮвПДЕФФЧИігЂЮФНЬГЬОЭЪЧЗжСЫШ§ВПЗжЃЈЙўЙў) . вдЯТЗвыздгЂЬиЖћЕФЮФЕЕ

Hello World

АбЯТУцЕФДњТыБЃДцЮЊ omp.cc

#include <iostream>

#include <omp.h>

int main()

{

#pragma omp parallel for

for (char i = 'a'; i <= 'z'; i++)

std::cout << i << std::endl;

return 0;

} |

ШЛКѓ g++ omp.cc -fopenmpОЭПЩвдСЫ

ШыУХ

бЛЗЕФВЂааЛЏ

OpenMPЕФЩшМЦУЧЯЃЭћЬсЙЉвЛжжМђЕЅЕФЗНЪНШУГЬађдБВЛашвЊЖЎЕУДДНЈКЭЯњЛйЯпГЬОЭФмаДГіЖрЯпГЬЛЏГЬађЁЃЮЊДЫЫћУЧЩшМЦСЫвЛаЉpragmaЃЌжИСюКЭКЏЪ§РДШУБрвыЦїФмЙЛдкКЯЪЪЕФЕиЗНВхШыЯпГЬДѓЖрЪ§ЕФбЛЗжЛашвЊдкforжЎЧАВхШывЛИіpragmaОЭПЩвдЪЕЯжВЂааЛЏЁЃЖјЧвЃЌЭЈЙ§АбетаЉФеШЫЕФЯИНкЖМЖЊИјБрвыЦїЃЌФуПЩвдЛЈЗбИќЖрЕФЪБМфРДОіЖЈФФРяашвЊЖрЯпГЬКЭгХЛЏЪ§ОнНсЙЙ

ЯТУцИіетИіР§згАб32ЮЛЕФRGBбеЩЋзЊЛЛГЩ8ЮЛЕФЛвЖШЪ§ОнЃЌФужЛашвЊдкforжЎЧАМгЩЯвЛОфpragmaОЭПЩвдЪЕЯжВЂааЛЏСЫ

#pragma omp

parallel for

for (int i = 0; i < pixelCount; i++) {

grayBitmap[i] = (uint8_t)(rgbBitmap[i].r * 0.229

+

rgbBitmap[i].g * 0.587 +

rgbBitmap[i].b * 0.114);

} |

ЩёЦцАЩЃЌЪзЯШЃЌетИіР§згЪЙгУСЫЁАwork sharingЁБЃЌЕБЁАwork sharingЁББЛгУдкforбЛЗЕФЪБКђЃЌУПИібЛЗЖМБЛЗжХфЕНСЫВЛЭЌЕФЯпГЬЃЌВЂЧвБЃжЄжЛжДаавЛДЮЁЃOpenMPОіЖЈСЫЖрЩйЯпГЬашвЊБЛДђПЊЃЌЯњЛйКЭДДНЈЃЌФуашвЊзіЕФОЭЪЧИцЫпOpenMPФФРяашвЊБЛЯпГЬЛЏЁЃ

OpenMP ЖдПЩвдЖрЯпГЬЛЏЕФбЛЗгаШчЯТЮхИівЊЧѓЃК

бЛЗЕФБфСПБфСПЃЈОЭЪЧiЃЉБиаыЪЧгаЗћКХећаЮЃЌЦфЫћЕФЖМВЛааЁЃ

бЛЗЕФБШНЯЬѕМўБиаыЪЧ< <= > >=жаЕФвЛжж

бЛЗЕФдіСПВПЗжБиаыЪЧдіМѕвЛИіВЛБфЕФжЕЃЈМДУПДЮбЛЗЪЧВЛБфЕФЃЉЁЃ

ШчЙћБШНЯЗћКХЪЧ< <=ЃЌФЧУПДЮбЛЗiгІИУдіМгЃЌЗДжЎгІИУМѕаЁ

бЛЗБиаыЪЧУЛгаЦцЦцЙжЙжЕФЖЋЮїЃЌВЛФмДгФкВПбЛЗЬјЕНЭтВПбЛЗЃЌgotoКЭbreakжЛФмдкбЛЗФкВПЬјзЊЃЌвьГЃБиаыдкбЛЗФкВПБЛВЖЛёЁЃ

ШчЙћФуЕФбЛЗВЛЗћКЯетаЉЬѕМўЃЌФЧОЭжЛКУИФаДСЫ

МьВтЪЧЗёжЇГж OpenMP

#ifndef _OPENMP

fprintf(stderr, "OpenMP not supported");

#endif |

БмУтЪ§ОнвРРЕКЭОКељ

ЕБвЛИібЛЗТњзувдЩЯЮхИіЬѕМўЪБЃЌвРШЛПЩФмвђЮЊЪ§ОнвРРЕЖјВЛФмЙЛКЯРэЕФВЂааЛЏЁЃЕБСНИіВЛЭЌЕФЕќДњжЎМфЕФЪ§ОнДцдквРРЕЙиЯЕЪБЃЌОЭЛсЗЂЩњетжжЧщПіЁЃ

// МйЩшЪ§зщвбОГѕЪМЛЏЮЊ1

#pragma omp parallel for

for (int i = 2; i < 10; i++) {

factorial[i] = i * factorial[i-1];

}

|

БрвыЦїЛсАбетИібЛЗЖрЯпГЬЛЏЃЌЕЋЪЧВЂВЛФмЪЕЯжЮвУЧЯывЊЕФМгЫйаЇЙћЃЌЕУГіЕФЪ§зщКЌгаДэЮѓЕФНсЙЙЁЃвђЮЊУПДЮЕќДњЖМвРРЕгкСэвЛИіВЛЭЌЕФЕќДњЃЌетБЛГЦжЎЮЊОКЬЌЬѕМўЁЃвЊНтОіетИіЮЪЬтжЛФмЙЛжиаДбЛЗЛђепбЁдёВЛЭЌЕФЫуЗЈЁЃ

ОКЬЌЬѕМўКмФбБЛМьВтЕНЃЌвђЮЊвВгаПЩФмЧЁКУГЬађЪЧАДФуЯывЊЕФЫГађжДааЕФЁЃ

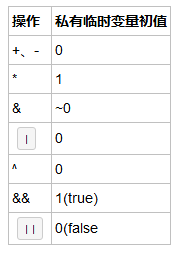

ЙмРэЙЋгаКЭЫНгаЪ§Он

ЛљБОЩЯУПИібЛЗЖМЛсЖСаДЪ§ОнЃЌШЗЖЈФЧИіЪ§ОнЪБЯпГЬжЎМфЙВгаЕФЃЌФЧаЉЪ§ОнЪБЯпГЬЫНгаЕФОЭЪЧГЬађдБЕФд№ШЮСЫЁЃЕБЪ§ОнБЛЩшжУЮЊЙЋгаЕФЪБКђЃЌЫљгаЕФЯпГЬЗУЮЪЕФЖМЪЧЯрЭЌЕФФкДцЕижЗЃЌЕБЪ§ОнБЛЩшЮЊЫНгаЕФЪБКђЃЌУПИіЯпГЬЖМгаздМКЕФвЛЗнПНБДЁЃФЌШЯЧщПіЯТЃЌГ§СЫбЛЗБфСПвдЭтЃЌЫљгаЪ§ОнЖМБЛЩшЖЈЮЊЙЋгаЕФЁЃПЩвдЭЈЙ§вдЯТСНжжЗНЗЈАбБфСПЩшжУЮЊЫНгаЕФЃК

дкбЛЗФкВПЩљУїБфСПЃЌзЂвтВЛвЊЪЧstaticЕФ

ЭЈЙ§OpenMPжИСюЩљУїЫНгаБфСП

// ЯТУцетИіР§згЪЧДэЮѓЕФ

int temp; // дкбЛЗжЎЭтЩљУї

#pragma omp parallel for

for (int i = 0; i < 100; i++) {

temp = array[i];

array[i] = doSomething(temp);

} |

ПЩвдЭЈЙ§вдЯТСНжжЗНЗЈИФе§

// 1. дкбЛЗФкВПЩљУїБфСП

#pragma omp parallel for

for (int i = 0; i < 100; i++) {

int temp = array[i];

array[i] = doSomething(temp);

} |

// 2. ЭЈЙ§OpenMPжИСюЫЕУїЫНгаБфСП

int temp;

#pragma omp parallel for private(temp)

for (int i = 0; i < 100; i++) {

temp = array[i];

array[i] = doSomething(temp);

} |

Reductions

вЛжжГЃМћЕФбЛЗОЭЪЧРлМгБфСПЃЌЖдДЫЃЌOpenMP газЈУХЕФгяОф

Р§ШчЯТУцЕФГЬађЃК

int sum = 0;

for (int i = 0; i < 100; i++) {

sum += array[i]; // sumашвЊЫНгаВХФмЪЕЯжВЂааЛЏЃЌЕЋЪЧгжБиаыЪЧЙЋгаЕФВХФмВњЩње§ШЗНсЙћ

} |

ЩЯУцЕФетИіГЬађРяЃЌsumЙЋгаЛђепЫНгаЖМВЛЖдЃЌЮЊСЫНтОіетИіЮЪЬтЃЌOpenMP ЬсЙЉСЫreductionгяОфЃЛ

int sum = 0;

#pragma omp parallel for reduction(+:sum)

for (int i = 0; i < 100; i++) {

sum += array[i];

} |

ФкВПЪЕЯжжаЃЌOpenMP ЮЊУПИіЯпГЬЬсЙЉСЫЫНгаЕФsumБфСПЃЌЕБЯпГЬЭЫГіЪБЃЌOpenMP дйАбУПИіЯпГЬЕФВПЗжКЭМгдквЛЦ№ЕУЕНзюжеНсЙћЁЃ

ЕБШЛЃЌOpenMP ВЛжЙФмзіРлМгЃЌЗВЪЧРлМЦдЫЫуЖМЪЧПЩвдЕФЃЌШчЯТБэЃК

бЛЗЕїЖШ

ИКдиОљКтЪЧЖрЯпГЬГЬађжаЖдадФмгАЯьзюДѓЕФвђЫиСЫЃЌжЛгаЪЕЯжСЫИКдиОљКтВХФмБЃжЄЫљгаЕФКЫаФЖМЪЧУІЕФЃЌЖјВЛЛсГіЯжПеЯаЪБМфЁЃШчЙћУЛгаИКдиОљКт,

гавЛаЉЯпГЬЛсдЖдЖдчгкЦфЫћЯпГЬНсЪј, ЕМжТДІРэЦїПеЯаРЫЗбгХЛЏЕФПЩФм.

дкбЛЗжаЃЌОГЃЛсгЩгкУПДЮЕќДњЕФЯрВюЪБМфНЯДѓКЭЦЦЛЕИКдиЦНКтЁЃЭЈГЃПЩвдЭЈЙ§МьВщдДТыРДЗЂЯжбЛЗЕФБфЖЏПЩФм.

ДѓЖрЪ§ЧщПіЯТУПДЮЕќДњПЩФмЛсЗЂЯжДѓИХвЛжТЕФЪБМфЃЌЕБетИіЬѕМўВЛФмТњзуЕФЪБКђЃЌФуПЩФмФмевЕНвЛИіЛЈЗбСЫДѓИХвЛжТЪБМфЕФзгМЏЁЃР§Шч,

гаЪБКђЫљгаХМЪ§бЛЗЛЈЗбСЫКЭЫљгаЦцЪ§бЛЗвЛбљЕФЪБМф, гаЪБКђПЩФмЧАвЛАыбЛЗКЭКѓвЛАыбЛЗЛЈЗбСЫЯрЫЦЕФЪБМф.

СэвЛЗНУц, гаЪБКђФуПЩФмевВЛЕНЛЈЗбЯрЭЌЪБМфЕФвЛзщбЛЗ. ВЛТлШчКЮ, ФугІИУАбетаЉаХЯЂЬсЙЉИј OpenMP,

етбљВХФмШУ OpenMP гаИќКУЕФЛњЛсШЅгХЛЏбЛЗ.

ФЌШЯЧщПіЯТЃЌOpenMPШЯЮЊЫљгаЕФбЛЗЕќДњдЫааЕФЪБМфЖМЪЧвЛбљЕФЃЌетОЭЕМжТСЫOpenMPЛсАбВЛЭЌЕФЕќДњЕШЗжЕНВЛЭЌЕФКЫаФЩЯЃЌВЂЧвШУЫћУЧЗжВМЕФОЁПЩФмМѕаЁФкДцЗУЮЪГхЭЛЃЌетбљзіЪЧвђЮЊбЛЗвЛАуЛсЯпадЕиЗУЮЪФкДц,

ЫљвдАббЛЗАДееЧАвЛАыКѓвЛАыЕФЗНЗЈЗжХфПЩвдзюДѓГЬЖШЕФМѕЩйГхЭЛ. ШЛЖјЖдФкДцЗУЮЪРДЫЕетПЩФмЪЧзюКУЕФЗНЗЈ,

ЕЋЪЧЖдгкИКдиОљКтПЩФмВЂВЛЪЧзюКУЕФЗНЗЈ, ЖјЧвЗДЙ§РДзюКУЕФИКдиОљКтПЩФмвВЛсЦЦЛЕФкДцЗУЮЪ. вђДЫБиаыелждПМТЧ.

OpenMP ИКдиОљКтЪЙгУЯТУцЕФгяЗЈ

| #pragma omp

parallel for schedule(kind [, chunk size]) |

ЦфжаkindПЩвдЪЧЯТУцЕФетаЉРраЭ, Жј chunk size дђБиаыЪЧбЛЗВЛБфЕФе§ећЪ§

Р§зг

#pragma omp

parallel for

for (int i = 0; i < numElements; i++) {

array[i] = initValue;

initValue++;

} |

ЯдШЛетИібЛЗРяОЭгаСЫОКЬЌЬѕМў, УПИібЛЗЖМвРРЕгк initValue етИіБфСП, ЮвУЧашвЊШЅЕєЫќ.

#pragma omp

parallel for

for (int i = 0; i < numElements; i++) {

array[i] = initValue + i;

} |

етбљОЭПЩвдСЫ, вђЮЊЯждкЮвУЧУЛгаШУ initValue ШЅБЛвРРЕ

Ыљвд, ЖдгквЛИібЛЗРДЫЕ, гІИУОЁПЩФмЕиАб loop-variant БфСПНЈСЂдк i ЩЯ.

|