| 编辑推荐: |

本文主要介绍了智能座舱中控HMI基于情景感知的主动交互设计相关内容。希望对你的学习有帮助。

本文来自于微信公众号智能座舱与HML设计,由火龙果软件Linda编辑、推荐。 |

|

情景感知指的是机器对一定范围内时间和空间要素的感知、理解与预测,它涉及人类意图的复杂性及解决机器与人类认知冲突等问题。

在智能座舱中,情景感知通过采集环境和用户数据,预测并响应驾驶员需求,提供个性化的服务。其应用包括对车内外环境、驾驶员生理与行为状态的感知,基于这些数据的推理与预测,使系统能够主动响应驾驶员的需求。

主动交互是指智能座舱系统在识别并理解驾驶员的需求后,主动做出反馈。主动交互不仅基于情景感知数据进行预测,还通过系统的反馈与调整,使得整个驾驶过程更加顺畅与个性化。

情景感知与主动交互的结合,使得智能座舱能够在实时感知驾驶员情感、行为和驾驶环境的基础上,进行精准的预测与响应。通过这种互动,系统能够根据驾驶员的疲劳状态、情绪变化等进行主动调整,如自动调节座椅、推荐路线等,提升驾驶体验。

一、基于多通道感知与多模态集成的主动交互

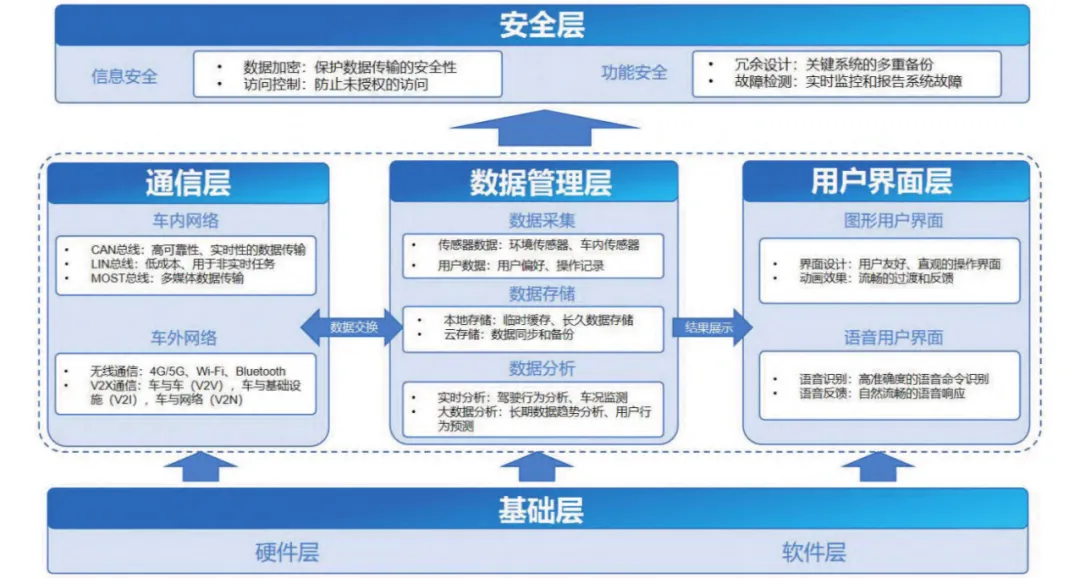

1.智能座舱中控HMI系统以软硬件为基础,通过通信层、数据管理层和用户界面层表现出来,以达到安全层的需要。

智能座舱中控 HMI 系统架构图

在此基础上,智能座舱中控HMI主动交互流程可以分为:情景数据感知与分析、多模交互分析、基于分析产生主动交互设计方案、场景设计四个部分。

2.智能座舱中控HMI的典型交互

相较于传统的单模交互,多通道感官的信息获取和多方式的交互路径可以提升人车交互的准确性、降低用户认知负荷,避免用户在复杂的行车情境中占用过多的注意力资源。因此,多通道交互被认为是智能座舱中控HMI的最佳交互方式。

(1)车载语音交互流程。在传统的语音交互中,人车交互流程主要包括以下四个环节:用户发起、车机响应、用户反馈和车机执行,这种交互模式在一定程度上满足了用户的需求,但仍有一定的局限性和进步空间。

而在主动交互视域下,人车交互路径变为车机发起、用户响应、车机执行,用户接到车机的交互请求后,根据自身需求进行响应,车机将更加主动地关注用户的需求,在接收到用户的响应后,会立即执行相应的操作,人车交互变得更加高效、便捷。

(2)次要驾驶任务手势交互模式。新型传感器技术、先进的模式识别算法、生物认知技术以及无标记运动捕捉技术如外设、体感控制器等为各种场景下的交互提供了更为自然和直观的方式。

近年来,基于手势的输入方式逐渐受到广泛关注,并逐步应用于车载信息系统,通过使用手势命令,驾驶员可以在驾驶过程中随时关注道路状况,无需分心操作车载信息系统,这种方式可以有效减少驾驶员在中央显示器和道路之间分散视觉注意力的情况,从而提高行车安全性。

目前,基于手势的汽车控制系统研究主要可分为两大类别:一类是基于静态手势的应用,主要关注如何通过手势识别技术来实现对车内信息的查询和控制;

另一类是基于动态手势的应用,开发者则更加关注如何利用动态手势的灵活性和自然性,为用户提供更为便捷和舒适的驾驶体验。

(3)典型交互组合策略。在智能座舱的交互设计中,典型交互组合形式根据占比可以分为互补性和非互补性。互补性交互组合指的是多种交互方式相互协作,共同增强信息传递的效果,在这一过程中,其他模态是主导模态的补充和扩展,使信息传递更高效。

例如,语音和视觉两种交互模态可以相互补充,共同提高信息的传递效率,语音识别作为主要交流形式,通过语音指令实现人与汽车之间的沟通;而视觉交互则通过图像识别、显示屏幕等方式,强化和扩展了语音指令的信息表达。

非互补性交互组合中的各种交互方式则相对独立又相互协作,用户可以运用多种交互形式与智能汽车进行互动。

例如,在中控HMI的导航系统中,用户可以通过语音识别、触摸屏操作和手势控制等多种方式实现便捷的路线规划和导航功能。在智能汽车典型交互领域中,各模态优先级在不同情况下应可以灵活调整。如白天用户偏好语音交互,夜间为避语音干扰则更偏向选择界面控制。

此外,在复杂环境中,智能系统对不同模态信息的关注程度与模态强度正相关。因此,智能汽车信息交互设计需在满足用户需求的同时,识别不同情境和用户群体的高强度模态信息,并采用合适的智能交互方式。

3.智能座舱中控HMI的主动交互模型

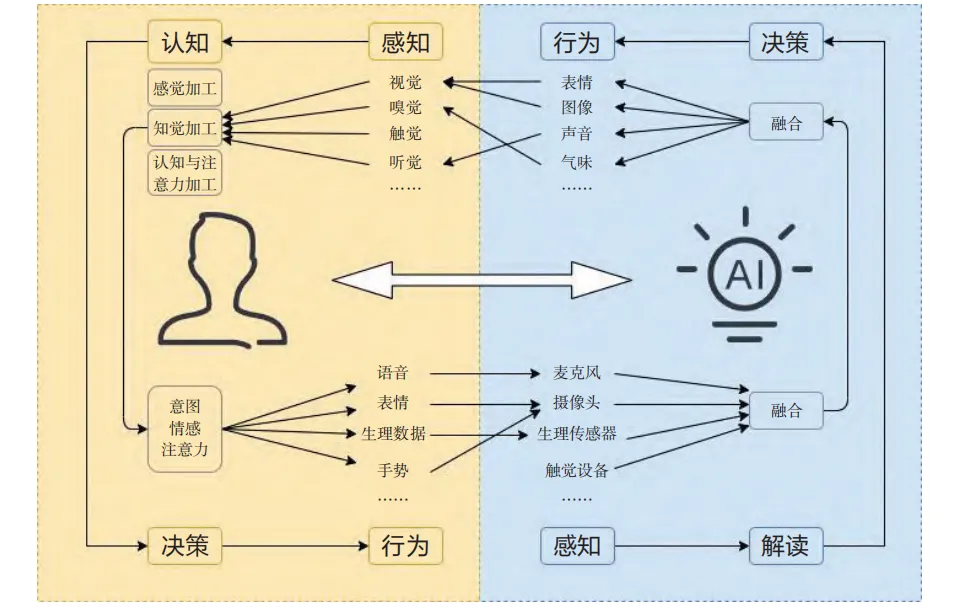

通过探究用户与人工智能的感知、行为和决策等特点及相关关系,明确智能座舱HMI主动交互的内在逻辑,构建基于情景感知的HMI交互模型,从而提升多感官集成与智能技术在人机交互中的作用。

智能座舱中控 HMI 主动交互模型

主动交互模型解释了整个交互过程的闭环机制,确保信息的双向流动与反馈,左侧分析用户的感知、认知、决策和行为,得到用户自身的交互路径;右侧的人工智能代表智能处理系统,通过生理传感器接收到驾驶员的生理指标信号并通过GPS等传感器感知到车机和环境信号后,融合多维数据判定驾驶员所处的场景以及其情绪状态并执行相应的操作,如调整车内环境或提供反馈,并通过多感官形式反馈给驾驶员;用户和人工智能中间的横条代表信息处理的过程。

利用该模型进行设计可以优化驾驶体验,改善驾驶员的负面情绪,并提升用户与智能车载产品的交互效果。

二、主动交互在中控HMI设计中的实践

1.用户需求调研与分析

用户需求调研选择了20名年龄主要在30~50岁之间的被试人员,平均驾龄五年,其中包括15名男性和五名女性,被试人员均有对智能座舱中控HMI自动(辅助)驾驶的体验。围绕着目标群体主动交互的使用体验、偏好和期望进行。

综合调研结果得到以下结论:

(1)用户普遍对主动交互功能持开放态度,尤其是年轻用户群体,但他们的需求和期望各异,涵盖从导航、安全到娱乐和舒适性各个方面;

(2)用户在交通拥堵时容易出现情绪波动,存在行车安全隐患;

(3)用户特别强调交互系统的易用性、直观性、准确性、个性化和响应速度。

基于这些调研结论,下面选取“用户在通勤途中遇到交通拥堵”这一场景进行接下来的主动交互设计。

2.典型场景下智能座舱中控HMI主动交互设计

以“智能座舱中控HMI在用户通勤途中遇到交通拥堵”这一场景为例,结合用户画像,利用主动交互的方式主动为用户提供情绪安抚,后续对设计方案进行验证。

在该研究案例中,以用户在峰值通勤时间遇到交通拥堵的环境为研究背景,旨在通过主动交互方式对用户的情绪状态进行实时监控和积极干预,以缓解由交通拥堵引起的负面情绪,引导用户行为。

通过监测感知车内外环境数据和人体数据得到基础数据,中控系统进行数据融合与分析并筛选出最优交互决策,中控HMI主动向用户发起交互行为,使用户获得正向反馈。

下图是整个过程的系统逻辑框架。

堵车场景情绪安抚的主动交互逻辑

具体的设计主要分为三个部分,即系统感知车内外环境和用户信息、智能座舱中控HMI发起主动交互和用户出发效果,接下来将对此分别进行阐释。

(1)系统感知车内外环境和用户信息。在堵车场景中,车辆GPS系统接收到的数据显示当前路段有大量车辆缓慢移动或静止的信号,车辆的前向雷达和摄像头传感器连续检测到前方车辆的距离很近且几乎未移动,同时,车辆的速度传感器显示车速持续低于正常行驶速度且有频繁的停止和启动情况。

车辆的中央处理单元(CPU)和车载AI系统融合多源数据并结合历史交通数据进行分析,判断“车辆处于堵车状态并预计堵车持续15分钟”。

车辆内部,传感器监测到用户心率持续升高;摄像头捕捉到用户面部眉头紧锁且肌肉紧张;语音识别系统分析显示用户语速加快、语调升高;同时,车辆分析发现用户出现频繁急刹车或急加速。基于以上信息,中央处理单元确认用户当前处于“烦躁”状态。

(2)智能座舱中控HMI发起主动交互。在智能汽车HMI设计中,导航等基础功能优先,其次是触觉输入和视听反馈,音视频娱乐及游戏功能排在第三,目前,语音控制是最成熟的解放双手操作和减少注意力分散的解决方案。

据此,本文主要采用语音和手势进行主动交互。人工智能(AI)驾驶助手小鹏共有驾驶状态和交互状态两种形态,驾驶状态小鹏为一个圆形图标,通过语音和文字的拟人化互动方式增强驾驶员的信任感。

在主动交互状态下,小鹏的形态为能变换表情的圆形形象,浮于HMI界面上方。堵车时,小鹏会以语音和文字的形式告知用户当前情景和预计持续时长,提示过后主动变为交互状态,且向用户发起主动交互,例如下图小鹏提示用户“预计堵车15分钟”“叮咚,您的语音助手小鹏已上线”以及“堵车别焦躁,您可以在五秒内挥挥手来跟我玩个游戏”。

如果用户拒绝,小鹏会变回驾驶状态;如果用户同意,小鹏会开启“花瓣轻舞”模式,结合视觉、听觉和触觉等多种方式完成主动交互。

(3)用户互动触发效果。用户在智能座舱中控HMI面前挥手,深度感知摄像头捕捉用户实时动作后,中控系统进行计算、检测、手势跟踪和手势特征提取,识别出特定的挥手手势,通过视听觉反馈通知用户“手势识别成功”并触发启动预设的花瓣掉落动画脚本,动画控制管理器激活预定义的小鹏弹跳动画序列。

除此之外,系统还会触发音乐播放器、按摩控制系统和香薰扩散器,从多个角度来缓解用户焦躁情绪。

写在最后

智能座舱中控HMI主动交互体验中,情景感知与多通道交互为两大核心要素,构建基于情景感知的主动交互模型,为智能座舱用户体验优化提供新思路。

通过设计与验证典型场景下的主动交互体验,证明其在提升用户体验和驾驶安全性方面的有效性,并为智能座舱HMI设计发展提供实证基础。 |