| 编辑推荐: |

本文介绍了从人机协作角度设计人车交互的方法,该方法主要由三部分组成:智能感知、预测与决策模块,自适应用户界面模块以及智能语音模块。希望对你的学习有帮助。

本文来自于微信公众号智能座舱与HML设计,由火龙果软件Linda编辑、推荐。 |

|

人机交互(HMI)是从将汽车视为机器的角度来指代人车交互设计。如果将概念从人机交互(HMI)转换为人机协作(HRI),可以极大地拓展创新空间,推动汽车作为智能系统的自然交互发展。

从人机协作的角度进行设计,对于自动驾驶汽车更为重要,它能为用户提供从驾驶控制到车载功能和互联服务更一致的智能体验。本文介绍了从人机协作角度设计人车交互的方法,该方法主要由三部分组成:智能感知、预测与决策模块,自适应用户界面模块以及智能语音模块。

1. 前言

人车交互设计主要经历了三个阶段 。

在第一阶段,主要任务是为驾驶的主要任务设计控制装置,并引入仪表来告知驾驶员车辆的行驶状况和机械状况。

在第二阶段,行业面临的主要问题是如何有效地传输信息,以及驾驶员如何在较少分心和工作量的情况下操作和控制车辆。

在第三阶段,随着更多新技术和应用(如车载应用、互联服务、高级驾驶辅助系统(ADAS)和自动驾驶)被添加到汽车中,人车交互设计的主要任务转变为更好地支持用户利用各种类型的功能和服务。

然而,从人机交互的角度设计人车交互的概念将极大地限制智能座舱设计的创新。另一方面,从人机交互(HMI)的角度转换为人机协作(HRI)的角度,可以极大地拓宽设计创新的范围。

本文主要介绍人机协作系统的整体机制是怎样的,它如何通过智能感知、预测、决策模块预测功能和服务需求,并通过自适应视觉界面和智能语音与用户进行交互。还将通过一个案例详细说明人机协作系统是如何工作的。

2. 人机协作系统的工作机制

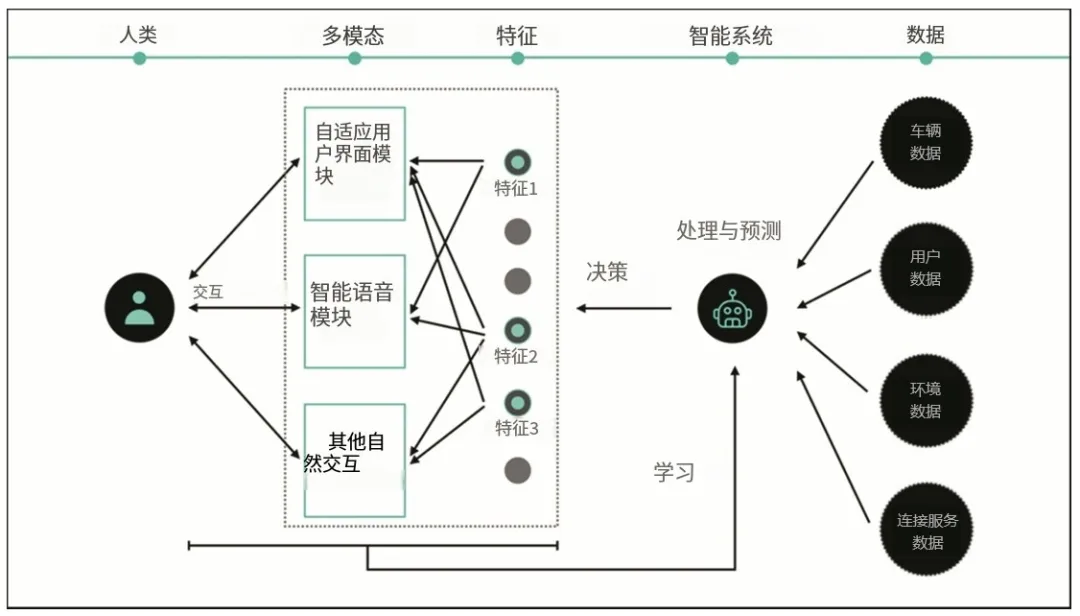

人机协作系统的工作机制主要包括以下四个步骤(见图 1)。首先,智能系统对来自各种来源的数据进行处理和分析。

其次,它预测用户在当前情境下可能需要的功能,并决定功能构成及其相应权重。然后,将生成或触发不同模态的界面,以适当的形式与用户进行交互。

最后,当用户与界面进行交互时,智能系统将进一步收集他们的反馈,并学习他们的行为模式,以提高其预测和决策能力。

图 1. 人机协作系统的工作机制

智能系统收集的数据主要包括车辆数据、用户数据、环境数据以及来自互联服务的数据,如速度、驾驶员状态、天气以及互联智能家居的状态等。

智能感知、预测和决策模块是人机协作系统的核心。用户与智能系统之间的界面主要包括自适应用户界面模块、智能语音模块以及其他自然交互界面。基于决策模块的预测,自适应用户界面模块可以自动生成满足用户需求且界面布局符合其操作习惯的界面。

智能语音模块是一个支持多轮对话、基于功能上下文设置 “唤醒” 词以及智能纠错的智能界面。此外,智能语音也是通过智能语音交互扩展用户知识图谱的重要途径。在合适的条件下,也可以使用其他自然交互方式,如空中手势、方向盘振动和眼球运动。

3. 智能感知、预测与决策模块

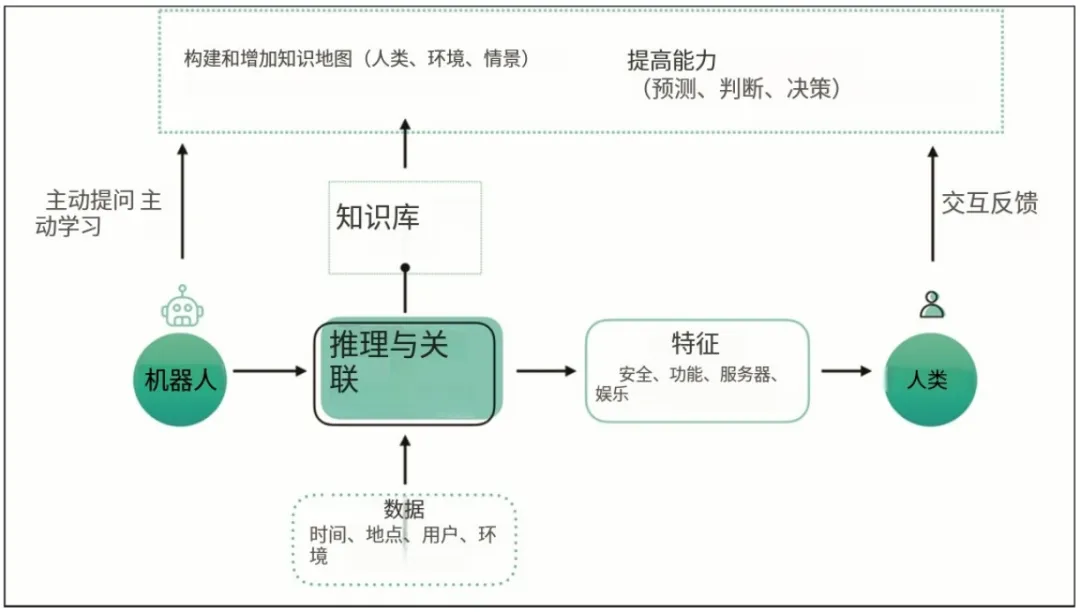

智能感知、预测与决策模块(ISPDM)包含三个子组件:

(1)数据采集;

(2)知识推理与关联;

(3)学习与知识图谱构建。

该模块利用从用户、车辆和环境中捕获的数据,基于知识图谱进行知识推理和关联,以预测用户意图,并决定触发相应的功能特征。构建个性化知识图谱并学习意图预测模型至关重要且必要。

然而,知识图谱和模型需要适应动态环境,无法完全预先构建。它应该具备终身学习的能力,并随着与用户的交互而不断进化(见图

2)。

图 2. 智能感知、预测与决策模块的框架

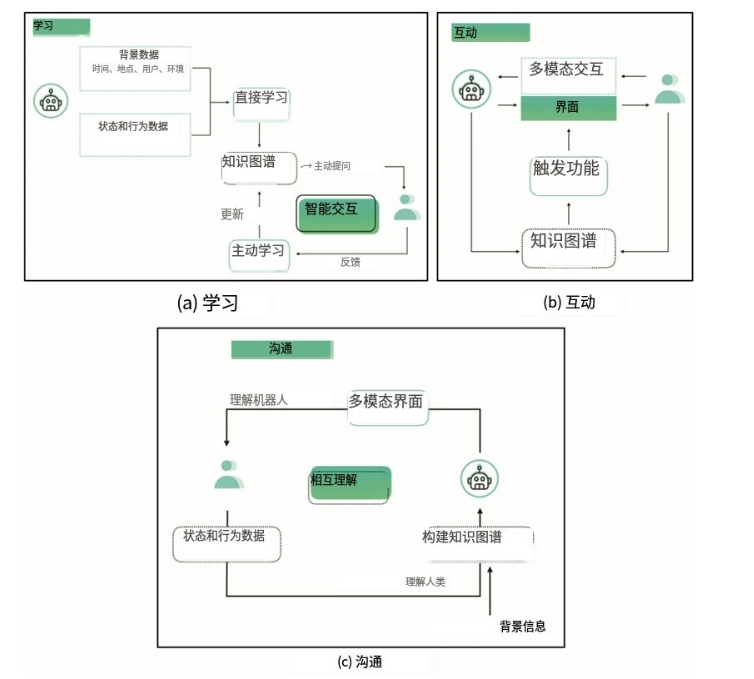

学习是智能感知、预测与决策模块的核心能力。如图 3(a)所示,最初的知识图谱和预测模型首先直接从收集到的训练数据中学习。由于训练数据有限,这些知识图谱和模型在意图预测方面通常效率不高。

该模块可以主动从用户那里获取必要的信息和反馈,然后不断更新知识图谱和模型,以提高其预测性能。通过意图预测,它将触发功能特征,并生成自适应界面以多种模态(如语音、视觉和触觉)与用户进行交互(见图

3(b))。

通过这些交互,该模块可以获取更多关于用户、车辆和环境的数据,进而对用户及其情境有更多的了解。如图

3(c)所示,在用户和系统之间形成了一个支持相互理解的闭环。

图 3. 智能感知、预测与决策模块的三个方面

4. 自适应用户界面模块

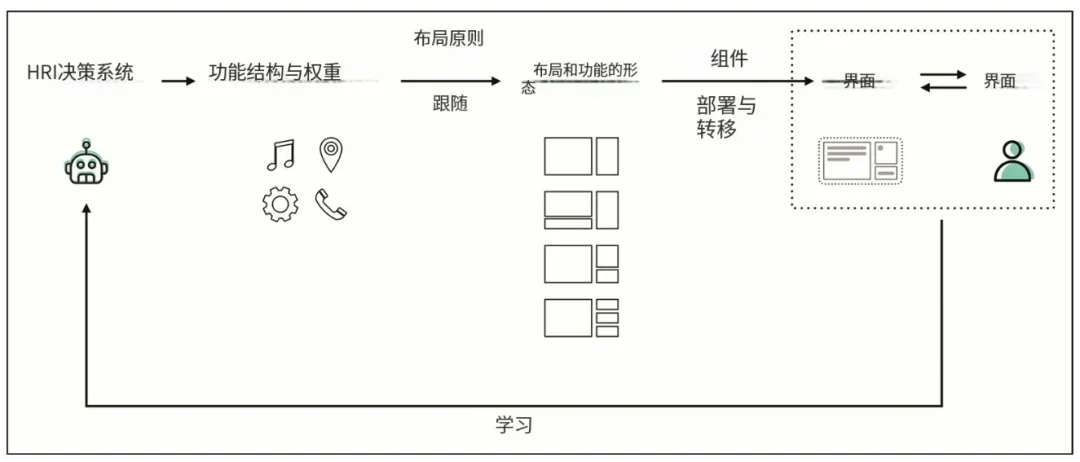

自适应用户界面模块是人机协作系统中的主要视觉界面。如图 4 所示,它接收来自智能感知、预测与决策模块的功能预测输入(功能构成和不同功能的权重)。然后根据布局原则确定这些功能的布局及其合适的显示形式。

最后,根据所选显示形式的要求,系统将部署合适的动态组件来形成界面。除了提供支持用户按需需求的自适应用户界面外,该模块还可以作为收集用户反馈或进行基于视觉界面的智能交互的接口。这可以进一步帮助人机协作系统更好地了解用户。

图 4. 自适应用户界面模块的工作机制

4.1 界面组成

基于人车交互设计的领域特定知识,界面内容主要包括:

(1)提供功能和服务的功能模块,如导航、媒体、电话、车载购物等;

(2)用于展示系统状态的信息,如时间和蜂窝网络连接状态;

(3)用于控制和显示车内环境和设备状态的组件。

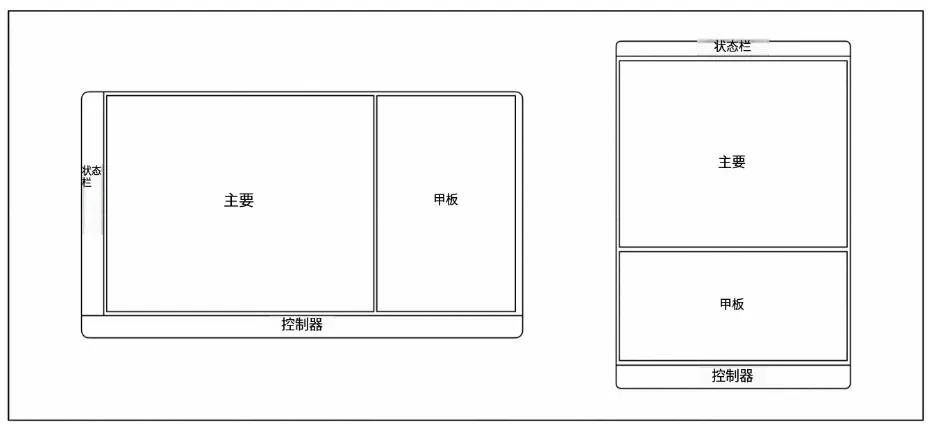

功能可以显示在两种类型的屏幕区域:主区域(Primary)和辅助区域(Deck)。

主区域是用户主要视觉焦点所在的地方,也是大多数交互发生的地方。通常主区域只显示一个主要功能。

辅助区域则是用于显示补充功能和信息的区域。系统状态可以放置在状态栏中。控制器区域可用于控制车内设备并显示车内环境的状态信息。

4.2 布局原则

基于通用的用户界面设计原则,并考虑驾驶条件,我们提出了以下自适应用户界面布局原则:

将主区域放置在离用户最近的区域:由于主区域放置的是最重要的功能或信息,为了确保用户以最方便和高效的方式获取信息和进行操作,主区域最好放置在离用户最近的区域。例如,在左舵驾驶车辆中,主区域最好放置在水平屏幕的左侧和垂直屏幕的上部(见图

5)。

将辅助区域放置在次要区域:辅助区域承载的是用户不是最需要的信息和功能,因此最好放置在次要区域,如左舵驾驶车辆中垂直屏幕的下部和水平屏幕的右侧(见图

5)。

将状态栏放置在符合阅读习惯的区域:状态栏是显示系统信息的重要区域。根据通用的用户界面布局原则和人们从左到右、从上到下的阅读习惯,在左舵驾驶车辆中,状态栏最好放置在垂直屏幕的顶部和水平屏幕的最左侧(见图

5)。

将控制器放置在底部:控制器是用户控制车内设备和查看其状态的关键区域。作为控制车内设备的物理按钮或旋钮的虚拟替代品,最好始终让用户能够使用控制器。因此,最好将其固定在屏幕底部(见图

5)。

为用户提供菜单:菜单是用户访问所有功能的入口。当系统推荐的主要功能与用户期望不匹配时,用户应该能够通过菜单选择他们想要使用的功能,菜单将以覆盖层的形式出现。

图 5. 自适应用户界面的布局示例

4.3 发展阶段

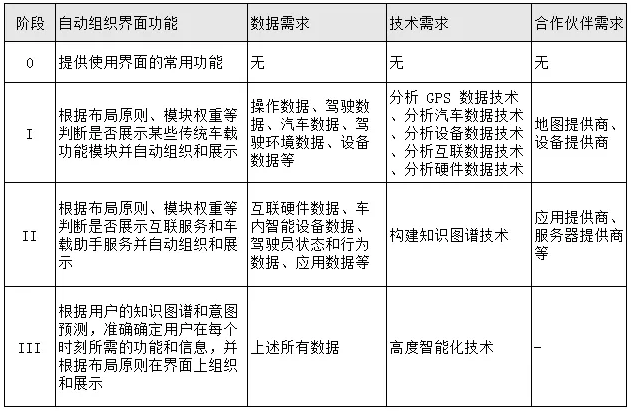

随着技术的进步以及数据和合作伙伴资源的可用性提高,自适应用户界面和所提出功能的开发可以逐步实现。表

1 总结了四个主要的发展阶段。

表 1. 自适应用户界面的发展阶段

阶段零:系统将为用户提供预设布局的默认功能集。当用户首次使用自适应用户界面时,它为用户提供一整套功能。用户可以随时通过菜单切换和选择他们想要的功能模块,然后将其放置在主区域或辅助区域。

阶段一:系统将能够积累和分析数据,并具备根据分析结果决定是否展示某个功能或信息以及将其展示在何处的能力。例如,基于驾驶信息和汽车信息,系统可以决定展示超速信息、低电量信息;

基于气候和环境信息,系统可以决定向用户发出谨慎驾驶的警告;基于驾驶场景和布局原则,系统可以决定将导航功能模块放置在主区域,将媒体和设备连接功能模块放置在辅助区域。

阶段二:随着越来越多的数据和合作伙伴的出现以及智能技术的发展,这个阶段的系统可以提供越来越多的个性化功能和基于场景的服务,如基于兴趣点(POI)的推荐。通过生成满足用户随时需求的不断变化的界面,自适应用户界面的优势可以得到最大程度的发挥。

阶段三:这是最先进的阶段,此时系统高度智能化,可以利用所有输入数据以及用户的知识图谱,随时准确预测他们的按需需求。系统不再将整个功能模块放置在主区域或辅助区域,而是能够找到某个功能中最需要关注的操作步骤或信息,并将它们展示在最突出的区域

—— 中心区域(Hub),如图 6 所示。

图 6. 自适应用户界面第三阶段的布局示例

5. 智能语音模块

作为一种无需用户用手操作且无需视觉关注用户界面的交互方式,语音交互是人车交互的不错选择。

然而,以目前自然语言处理技术的水平,很难为用户带来支持复杂任务的自然语音交互体验。在人机协作系统的整体机制下,我们提出了四种智能语音交互功能,提升智能座舱环境下的用户体验。

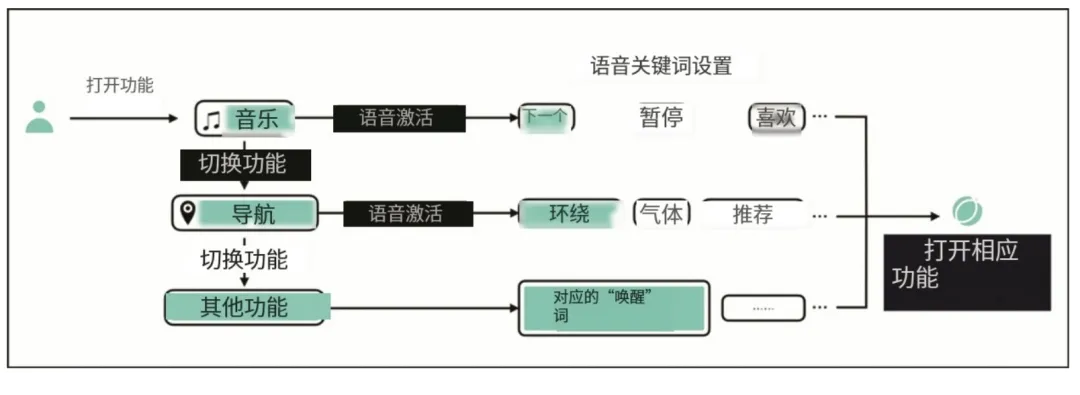

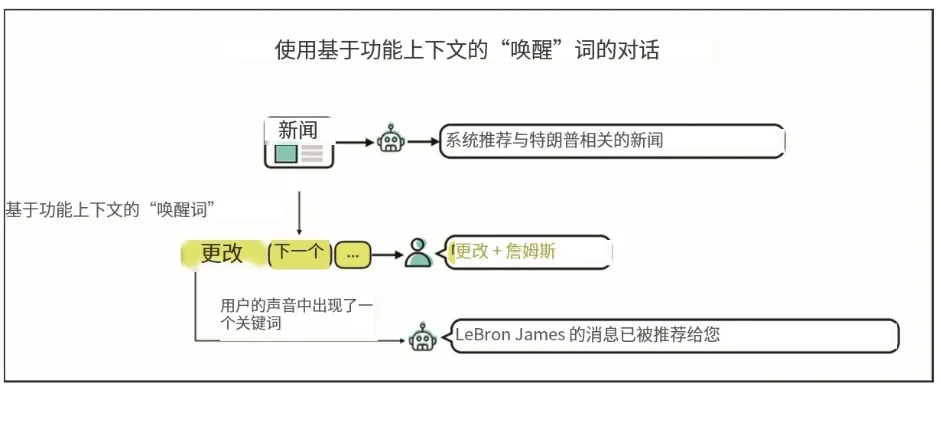

5.1 基于功能上下文的 “唤醒” 词机制

当用户仅需在当前运行的功能内执行特定任务时,每次都从功能的起始点唤醒语音系统并重新开始操作并不方便用户使用。为解决这一问题,我们提出了在每个功能下设置基于功能上下文的

“唤醒” 词机制。

例如,在媒体功能下设置 “播放下一首” 或 “下一曲”。当媒体正在播放时,用户想要切换到下一首歌,无需再次说出根

“唤醒” 词并从头开始,只需说 “播放下一首”,系统就会直接切换到下一首歌。通过这种方式,语音交互会变得更加自然,交互过程也会更简短(见图

7)。

图 7. 基于功能上下文的 “唤醒” 词机制

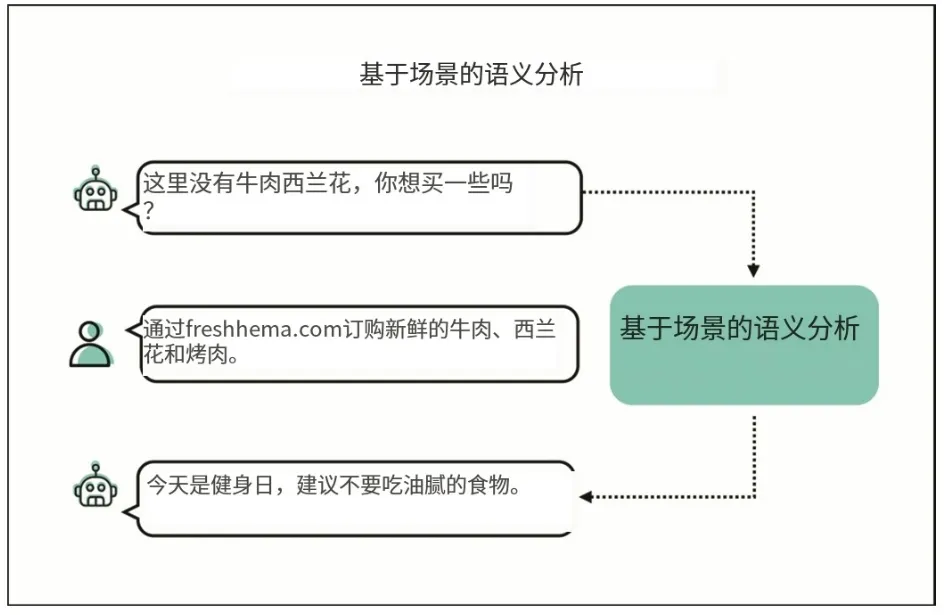

5.2 基于场景的多轮对话

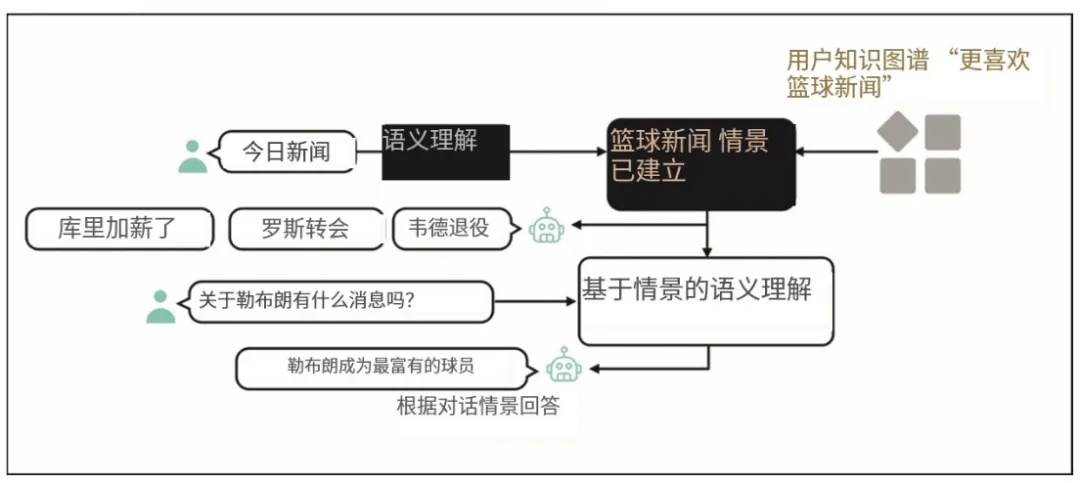

受当前语义分析技术的限制,构建多轮对话存在困难。在人机协作系统中,用户的知识图谱有助于构建对话场景,进而辅助分析用户输入的语义,支持多轮对话的生成。如图

8 所示,系统从用户的知识图谱中了解到他对 NBA 感兴趣,从而为第一轮回答及后续对话构建 NBA

新闻场景。

图 8. 基于场景的多轮对话

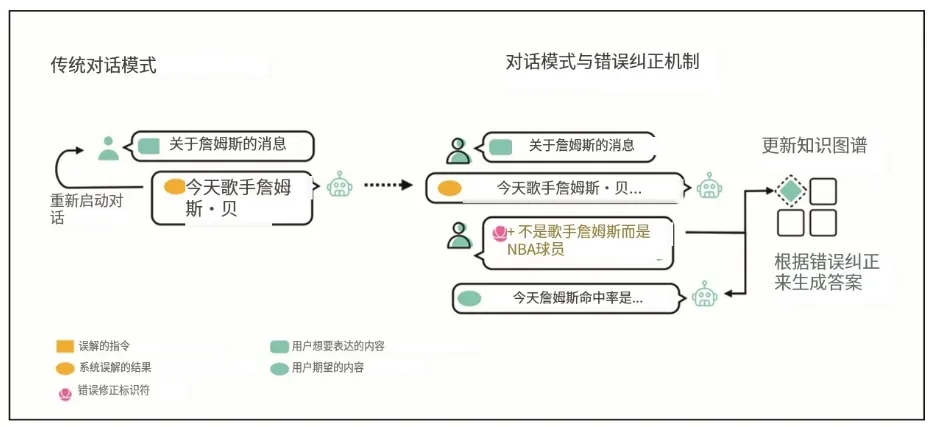

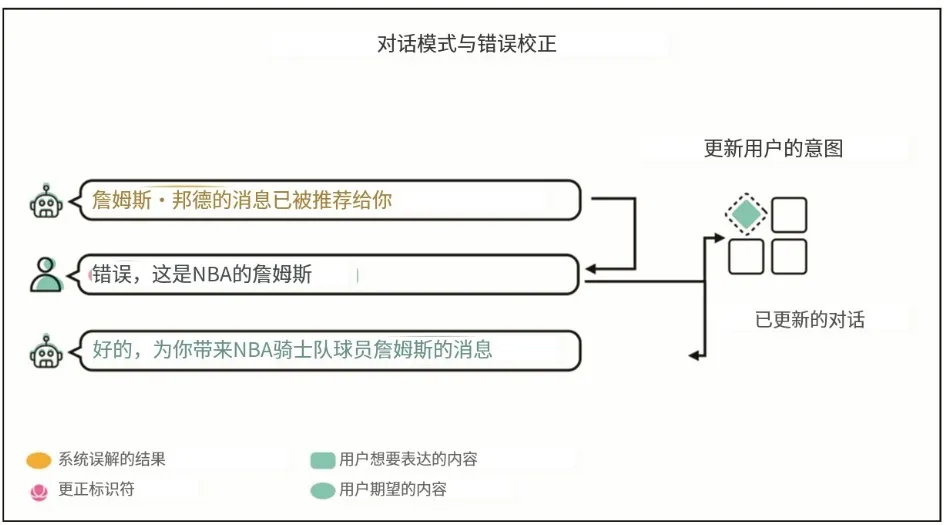

5.3 错误纠正机制

用户表达不清晰和预测准确率低是语音交互中导致错误的两个主要原因。人机协作系统的智能感知、预测与决策模块(特别是持续发展的用户知识图谱)有助于提高预测准确率。

我们还提出了一种机制,支持用户更准确地表达意图。当系统在对话中出现错误时,用户无需像当前大多数系统那样从头开始重新交互,而是可以使用纠错标识符(如

“不正确”)切换到纠错模式,并通过预定义的纠正模式说出正确意图来纠正误解。

例如,如图 9 所示,用户询问关于 “詹姆斯” 的新闻,系统返回关于歌手詹姆斯・贝的消息,而用户实际想关注的是

“詹姆斯”(NBA 球员勒布朗・詹姆斯)。此时,用户可以说 “不正确,不是这个詹姆斯,而是 NBA

球员勒布朗・詹姆斯”,系统将切换到关于勒布朗・詹姆斯的新闻。

图 9. 错误纠正机制

同时,人机协作系统会将用户对勒布朗・詹姆斯的兴趣更新到其知识图谱中,以支持未来更准确的预测。

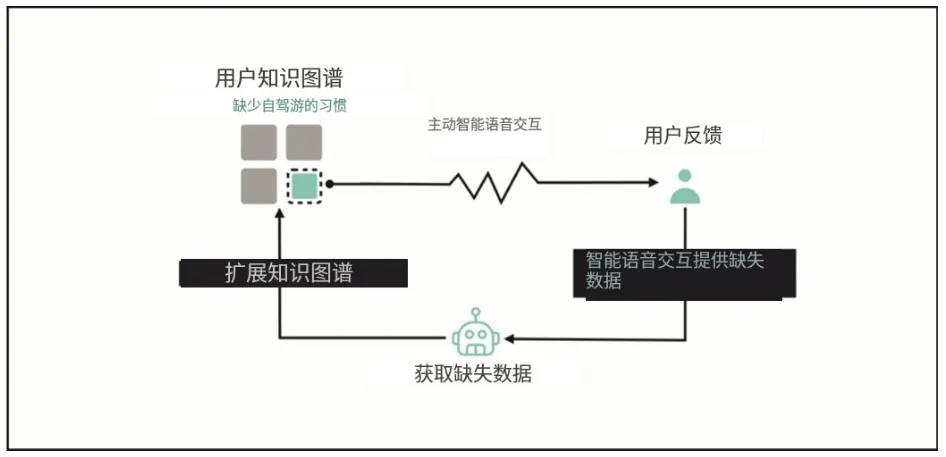

5.4 智能语音交互

作为一个类似机器人的智能系统,人机协作系统应该能够主动询问支持完成不同任务所需的必要信息。除了获取执行当前任务所需的信息外,获取用户的长期知识对智能系统也至关重要,这是其自主学习过程的一部分。

对于服务机器人,这可以通过智能交互实现,即通过精心设计的交互帮助系统获取提升能力所需的信息。智能交互可以通过多种方式进行。

在车辆中,语音是最合适的方式,因为它对驾驶员的干扰较小。当系统检测到用户知识图谱中存在缺失信息时,可以发起智能语音交互来获取信息并完善知识图谱。

例如,如图 10 所示,当假期临近时,系统考虑提醒用户如果他们喜欢自驾旅行,应到 4S 店进行车辆检查。然而,作为家庭新购车辆,系统没有关于他们自驾旅行习惯的信息,因此系统会主动询问这一情况。用户的回答不仅用于帮助系统决定反应,还会被添加到用户的知识图谱中。

图 10. 智能语音交互

6. 案例

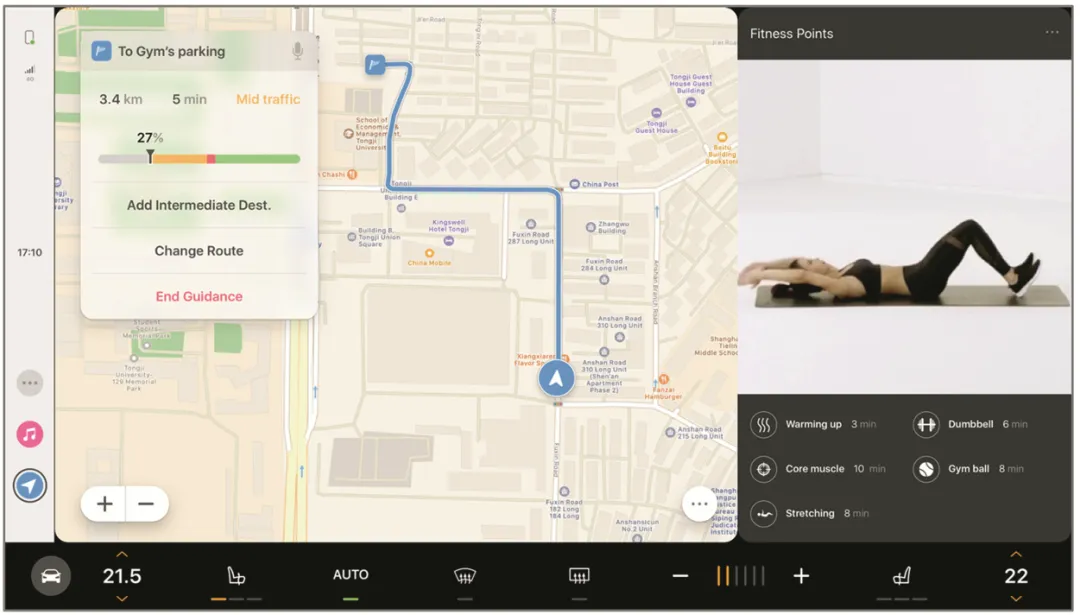

为了更好地说明上述人机协作系统,我们在此呈现一个案例:年轻人艾伦下班后前往健身房,之后返回家中。

在使用人机协作系统一段时间后,系统已构建了艾伦的个性化知识图谱,包括他每周五下班后去复兴路健身房的习惯,以及运动后吃牛肉和西兰花的习惯。

今天是周五,艾伦下班后正驾驶在复兴路上。基于日期、时间、位置、行驶方向和个人日程,智能系统预测他可能前往健身房。因此,系统发起智能语音交互,询问艾伦是否要去健身房。

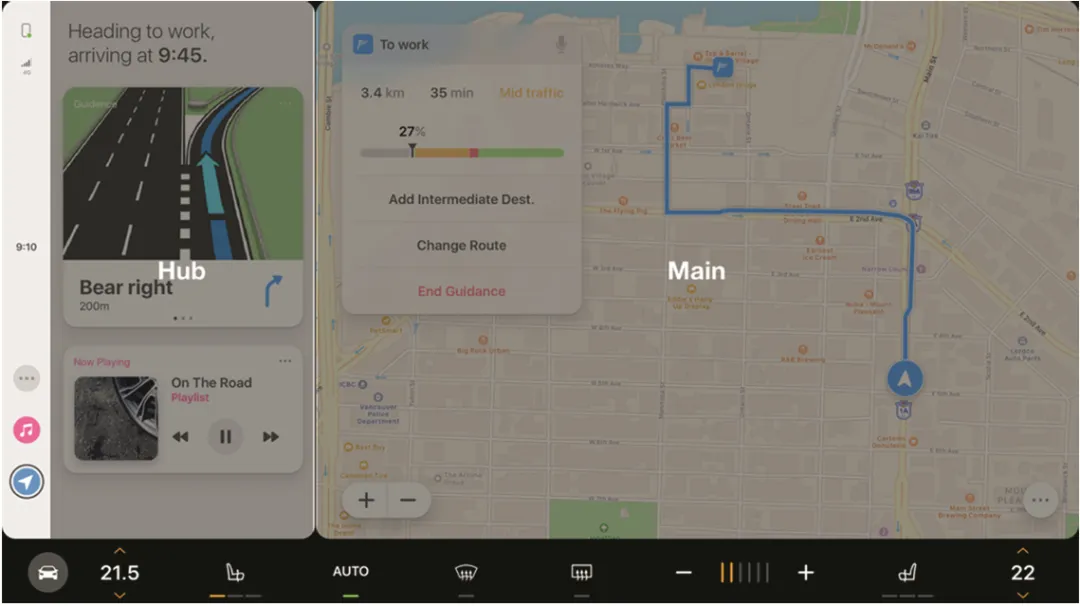

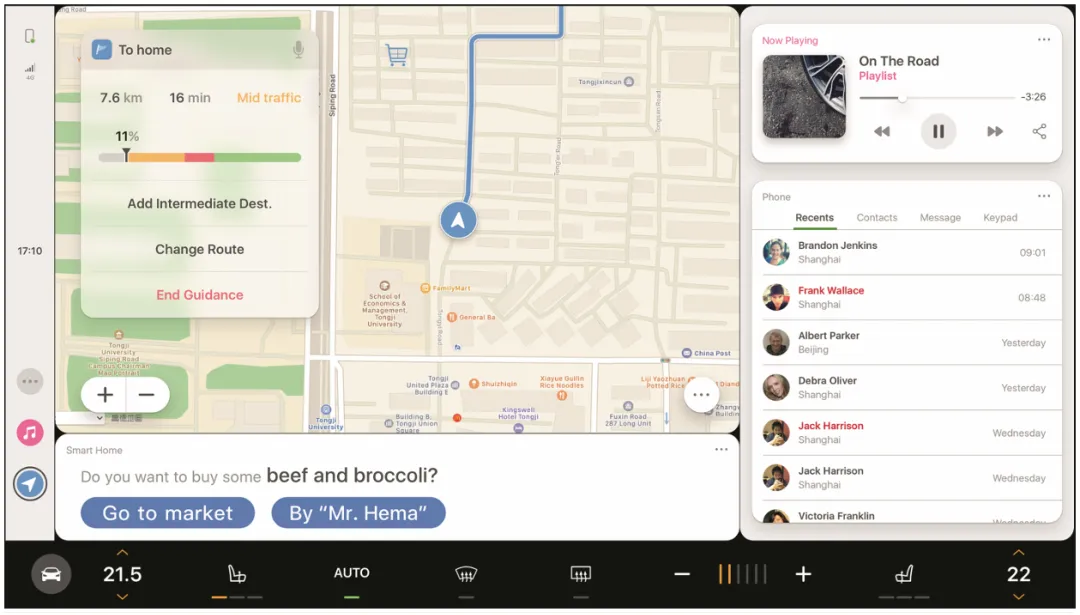

艾伦确认后,系统开始处理数据,包括健身房的位置、路况和周边停车场的占用率。然后,系统预订了离健身房入口最近的停车位,并通过语音和地图显示告知艾伦。屏幕的辅助区域(Deck)播放了一段今日运动小贴士的视频(见图

11)。

图 11. 显示停车位和行动提示的自适应用户界面

运动一小时后,艾伦回到车上。系统访问智能家居互联数据,发现艾伦家中的牛肉和西兰花储备不足。因此,系统通过语音告知艾伦这一情况,并询问他是想通过盒马鲜生订购,还是去附近市场购买。地图上也显示了附近市场的位置供参考(见图

12)。

图 12. 显示购物推荐的自适应用户界面

艾伦回答想通过盒马鲜生订购牛肉、西兰花和烤肉。系统分析后认为,运动后食用烤肉(高脂肪食物)不适合,建议艾伦不要选择此类油腻食物(见图

13)。

图 13. 基于场景的多轮对话

随后,基于车速、路况和交通灯等相关数据,智能系统意识到艾伦遭遇了交通拥堵。系统询问艾伦是否想听新闻打发时间,艾伦同意。进入新闻功能后,系统推荐了一些与暴风雪相关的新闻。艾伦说

“下一条”,基于功能上下文的 “唤醒” 词机制,系统继续播放今日天气新闻。艾伦接着说 “换,詹姆斯”,表示想听关于

“詹姆斯” 的新闻。系统根据知识图谱中艾伦对詹姆斯・邦德的兴趣,立即播放了相关新闻。

然而,艾伦此次想关注的是 NBA 篮球运动员勒布朗・詹姆斯。艾伦说 “错误” 进入纠错模式,要求系统切换到关于

NBA 詹姆斯的新闻(见图 14、15)。

图 14. 使用功能上下文 “唤醒” 词的对话

图 15. 带有错误纠正机制的对话

在整个过程中,系统主动发起了多轮智能语音交互。智能语音不仅作为帮助艾伦预订停车位、检查食材、打发等红绿灯无聊时间的界面,还帮助系统获取了更多关于艾伦的信息,例如他对

NBA 篮球运动员勒布朗・詹姆斯的新兴趣。系统将这些信息更新到艾伦的知识图谱中,相应地增强了对艾伦的理解,有助于未来做出更准确的预测。

7. 结论

本文提出了一种从人机协作角度设计的人车交互系统,主要包括三个模块:智能感知、预测与决策模块,自适应用户界面模块和智能语音模块。自适应用户界面可以根据智能系统预测的用户需求组织和展示所需功能。

具有四个创新功能的智能语音交互不仅为用户提供了自然的对话式交互体验,还通过智能语音交互帮助系统获取用户偏好,最终更好地理解用户。

本文旨在表明,从人机交互(HMI)转向人机协作(HRI)的视角可以开拓智能座舱设计的创新空间。本文还展示了一种跨学科方法,利用人工智能和人机协作技术的最新进展,拓展人车交互设计的边界。下一步,我们将对该系统进行用户评估,并进一步开发各组件模块。 |