| Spark�У���ν��Դ��λһ��ָ����executors����Yarn�е�Containersһ������Spark

On Yarnģʽ�£�ͨ��ʹ�èCnum-executors��ָ��Applicationʹ�õ�executors���������Cexecutor-memory�ͨCexecutor-cores�ֱ�����ָ��ÿ��executor��ʹ�õ��ڴ������CPU���������źܶ������������ύSparkӦ�ó���ʱ��ʹ�ø÷�ʽ��ָ����Դ��

�����������ij��������ʹ��Hive������û�ͬʱʹ��hive-cli�����ݿ����ͷ�����ֻ�е��û��ύִ����Hive

SQLʱ�Ż���YARN������Դ��ִ������������ύִ�У��Ǿ���ͣ����Hive-cli�����У�Ҳ���Ǹ�JVM���ѣ��������˷�YARN����Դ����������Spark-SQL����Hive�������ݿ����ͷ�����Ҳ�Ƕ��û�ͬʱʹ�ã��������֮ǰ�ķ�ʽ����yarn-clientģʽ����spark-sql�����У�http://lxw1234.com/archives/2015/08/448.htm����������ʱ��ָ���Cnum-executors

10����ôÿ���û�����ʱ��ʹ����10��YARN����Դ��Container������10����Դ�ͻ�һֱ��ռ���ţ�ֻ�е��û��˳�spark-sql������ʱ�Ż��ͷš�

spark-sql On Yarn���ܲ�����Hiveһ����ִ��SQL��ʱ���ȥ������Դ����ִ�е�ʱ����ͷŵ���Դ�أ���ʵ��Spark1.2֮����On

Yarnģʽ���Ѿ�֧�ֶ�̬��Դ���䣨Dynamic Resource Allocation�����������Ϳ��Ը���Application�ĸ��أ�Task���������̬�����Ӻͼ���executors�����ֲ��Էdz��ʺ���YARN��ʹ��spark-sql�����ݿ����ͷ������Լ���spark-sql��Ϊ��������ʹ�õij�����

������Spark1.5.0��hadoop-2.3.0-cdh5.0.0��������spark-sql On

Yarnģʽ�£����ʹ�ö�̬��Դ������ԡ�

YARN������

������Ҫ��YARN��NodeManager�������ã�ʹ��֧��Spark��Shuffle Service��

��ÿ̨NodeManager�ϵ�yarn-site.xml��

##��

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle,spark_shuffle</value>

</property>

##����

<property>

<name>yarn.nodemanager.aux-services.spark_shuffle.class</name>

<value>org.apache.spark.network.yarn.YarnShuffleService</value>

</property>

<property>

<name>spark.shuffle.service.port</name>

<value>7337</value>

</property> |

��$SPARK_HOME/lib/spark-1.5.0-yarn-shuffle.jar������ÿ̨NodeManager��${HADOOP_HOME}/share/hadoop/yarn/lib/�¡�

��������NodeManager��

Spark������

����$SPARK_HOME/conf/spark-defaults.conf���������²�����

spark.shuffle.service.enabled true //����External shuffle Service����

spark.shuffle.service.port 7337 //Shuffle Service����˿ڣ������yarn-site�е�һ��

spark.dynamicAllocation.enabled true //������̬��Դ����

spark.dynamicAllocation.minExecutors 1 //ÿ��Application��С�����executor��

spark.dynamicAllocation.maxExecutors 30 //ÿ��Application��������executor��

spark.dynamicAllocation.schedulerBacklogTimeout 1s

spark.dynamicAllocation.sustainedSchedulerBacklogTimeout 5s |

��̬��Դ������ԣ�

������̬������Ժ�application����task��û���㹻��Դ�������ʱ��ȥ��̬������Դ�����������ζ�Ÿ�application���е�executor����������task�������С�sparkһ��һ�ֵ�������Դ������task�����ȴ�spark.dynamicAllocation.schedulerBacklogTimeout(Ĭ��1s)ʱ���ʱ�Ὺʼ��̬��Դ���䣻֮���ÿ��spark.dynamicAllocation.sustainedSchedulerBacklogTimeout(Ĭ��1s)ʱ������һ�Σ�ֱ�����뵽�㹻����Դ��ÿ���������Դ����ָ�������ģ���1,2,4,8�ȡ�

֮���Բ���ָ�����������������濼�ǣ���һ����ʼ��������ǿ��ǵ�����application�����ϵõ����㣻���Ҫ�ɱ����ӣ���Ϊ�˷�ֹapplication��Ҫ�ܶ���Դ�����÷�ʽ�����ں��ٴ���������֮��õ����㡣

��Դ���ղ��ԣ�

��application��executor����ʱ�䳬��spark.dynamicAllocation.executorIdleTimeout��Ĭ��60s���ͻᱻ���ա�

ʹ��spark-sql On Yarnִ��SQL����̬������Դ

./spark-sql --master yarn-client \

--executor-memory 1G \

-e "SELECT COUNT(1) FROM ut.t_ut_site_log where pt >= '2015-12-09' and pt <= '2015-12-10'" |

�ò�ѯ��Ҫ123��Task��

��AppMaster��WEB������Կ������ܹ���31��Executors������һ����Driver������30��Executors����ִ�У���30��������spark.dynamicAllocation.maxExecutors���������õ�����������һ����ѯֻ��10��Task����ôֻ����Yarn����10��executors����Դ��

��Ҫע�⣺

���ʹ��

./spark-sql �Cmaster yarn-client �Cexecutor-memory

1G

����spark-sql�����У�����������ִ���κ�SQL��ѯ��������ִ�У�ԭ����spark-sql���ύ��Yarnʱ���Ѿ�������һ��Application�������֣�����Driver���Dz��ᱻ���䵽�κ�executors��Դ�ģ����У����ύ�IJ�ѯ��Ϊû��executor�����ܱ�ִ�С�

��������⣬��ʹ��Spark��ThriftServer��HiveServer2�����Խ����

ʹ��Thrift JDBC��ʽִ��SQL����̬������Դ

��ѡ��yarn-clientģʽ������Spark��ThriftServer����Ҳ����HiveServer2.

����ThriftServer�����Ķ˿ںź͵�ַ

vi $SPARK_HOME/conf/spark-env.sh

export HIVE_SERVER2_THRIFT_PORT=10000

export HIVE_SERVER2_THRIFT_BIND_HOST=0.0.0.0 |

��yarn-clientģʽ����ThriftServer

cd $SPARK_HOME/sbin/

./start-thriftserver.sh \

--master yarn-client \

--conf spark.driver.memory=3G \

--conf spark.shuffle.service.enabled=true \

--conf spark.dynamicAllocation.enabled=true \

--conf spark.dynamicAllocation.minExecutors=1 \

--conf spark.dynamicAllocation.maxExecutors=30 \

--conf spark.dynamicAllocation.sustainedSchedulerBacklogTimeout=5s |

������ThriftServer����Yarn����Ϊһ�������������У�

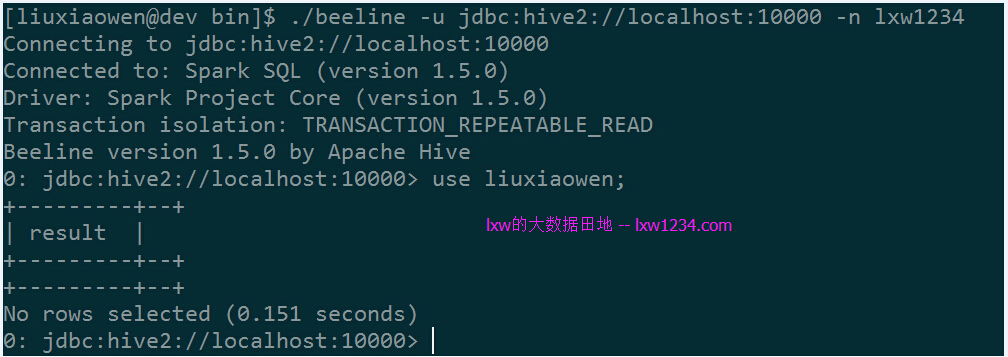

ʹ��beelineͨ��JDBC����spark-sql

cd $SPARK_HOME/bin

./beeline -u jdbc:hive2://localhost:10000 -n lxw1234 |

ִ�в�ѯ��

select count(1) from ut.t_ut_site_log

where pt = ��2015-12-10��;

��������64��Task��

�����ҳ���ϵIJ�������Ȼ��30��

ִ�����executors��ֻʣ��1����Ӧ���ǻ������ݣ������ȫ�������գ�

����������û�����ͨ��beeline��JDBC���ӵ�Thrift Server��ִ��SQL��ѯ������ԴҲ�Ƕ�̬����ġ�

��Ҫע����ǣ�������ThriftServerʱ��ָ����spark.dynamicAllocation.maxExecutors=30��������ThriftServerͬʱ�����������Դ�����������û�ͬʱ���ӣ���ᱻ����û������������ܹ�30����

������Ҳ���ǽ���˶��û�ͬʱʹ��spark-sql�����Ҷ�̬������Դ�������ˡ�

Spark��̬��Դ����ٷ��ĵ���http://spark.apache.org/docs/1.5.0/job-scheduling.html#dynamic-resource-allocation

�����Թ�ע lxw�Ĵ�������� ������ �����ʼ��б� ����ʱ���ղ����µ�֪ͨ�ʼ���

|