|

openstack������ϵ�У����缼��û�д��£����õ��ļ���������ӣ�����bridge��vlan��gre��vxlan��ovs��openflow��sdn��iptables�ȣ���Ȼ���ﲻ�������弼�����ܣ�������������Ҫ������openstack�Ľ�ϵ������������

nova-network����ܹ�

��nova-network�У�������ģ�Ͱ���flat��dhcp flat��vlan���õ��ļ�����Ҫ��bridge��vlan��

dhcp flat������ڵ�ܹ�

�������ṹ���ȶ�

ȱ�㣺ȫ���⻧����һ��ˮƽ���ϣ��⻧֮��û�и��룬��Ϊȫ���⻧����һ�������ڣ������ģ�������㲥�籩�����Dz�С�ĸ������أ�����������ģ����vm�����ޣ�����û�������y�ԡ�

vlan�ܹ�

Ϊ�⻧������ռ��bridge

����vlan�ӿ�vlan100������802.1qЭ���vlanid

Dnsmasq�����������أ�����fixedip�ķ���

switch port�趨Ϊchunk mode

eth0����vm֮�������ͨ�ţ�eth1���������L��

�������⻧�и���

ȱ�㣺��Ҫ����������chunk�ڵ�֧�֣�ʵ�ʲ���ʱ���^���ӣ�vlan id����Ϊ4094����Ҳ�������4094�������⻧���������ڹ����ơ�

����

�����neutron���磬��˵û��neutron��ô��Ĺ��ܲ��������bridge���������ȶ����ѵõ�������û�����֤������С��ģ��˽����(1ǧ̨����Ĺ�ģ)��nova-network���ܹ����ǵģ��������ϲ���Ļ���Ҳ��nova-network��

neutron����ܹ�

neutron������ϵ�����nova-networkҪ���ӵĶ࣬�õ��ļ�����Ҳ�����ӣ��ڽ�������ܹ�֮ǰ���б�Ҫ������gre��vxlan��ovs��openflow��sdn�����㡣

�����������vlan��������vlan id��������4094���������⻧�϶���ֹ4094�����㼼���������ܲ�����һ���������ڣ���ʵ�ֿ��������Ϊ��ͻ�����������ƣ�������gre��vxlan����������

GRE��

���������3��������������ԭ��С��ipͷǰ�����Ӵ���ipͷ��greͷ������ipͷ�����ip�ǹ���ip��

segment id����greͷ��������Ҫ���ֶ�Ӧ����4�ֽ�keyֵ��segment

id�����䵱��vlan���������vlan id�������⻧�����ã���Ϊ��4���ֽڣ��Ѿ�����4094 vlan

id���ơ���ͼ��gre����Ӧ��vpn��

��ȻgreҲ����ȱ�㣬

1.gre�ǵ�Ե㼼����ÿ������֮�䶼��Ҫ��һ������������4���port��Դ��һ���˷ѣ�

2.����ipͷ���Ʊؽ���vm��mtuֵ����ͬ��С�����ݣ���Ҫ�ܶ�������ip������������Ч����Ӱ�졣

VXLAN��

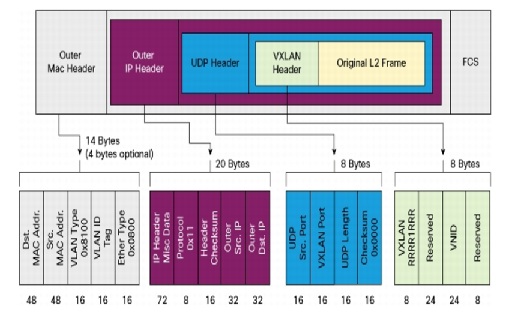

���vlan��gre�ĵ�һ��ȱ�㣬ҵ�������vxlan��������ͼ������vxlanͷ�ṹ��ͨ�����̡�

1.24bit��VNID��vxlan������ԭ��mac֡�������������µ�macͷ��ipͷ��vxlan

header����vxlan header�У�VNID�൱��vlan id��24bit��16M�Ĵ�С��Զ����4094.

2.��������磬ʵ�ֿ����������ͨ������������VTEP�豸���ܹ�Ӳ���豸��Ҳ�ܹ�����ʵ�֣���Ȼ��neutron�����У�����������ʵ�ֵġ����豸��¼vlan

id��vm mac��vtep ip����Ӧ��ϵ�������ϵ����vm����arp�����ȡ���ġ���vxlan�������и��鲥��ַ��ȫ��vtep�豸����Ҫ���Ӹ��鲥��ַ��vtep��arp�Ĺ㲥���������鲥ipͷת��Ϊ�鲥����һ��һ��vm����arp����ȫ��vtep�����յ���vtep�ڽ��鲥ipͷȥ������ԭʼ�㲥������vm��������ͬvm֮�佫������arp����vxlan����Ϊȫ��vm����һ����2�����硣

3.���������������ı� IP ��ַ����������Ǩ�Ƶ���������Ҳ�ܹ���������������Ľ���Ǩ�ƣ����������������ͬһ��

VLAN ��Ǩ�ƣ�

4.���ڿ����vxlan��ͨ��ǰ��ͨ���鲥��Ϣʵ��arp�Ĵ��䣬�����ڹ������ϣ��鲥�������������Ƶģ�����ҵ��ͨ���Ľ����ʽ��ͨ��SDN

controller��SDN controller����arp����������ȡvm�ڲ�mac�����VTEP ip��Ӧ��ϵ����ͬcontroller֮�佻����Щ��Ϣ��

���ۣ�

1.gre������vlan id�������ƺͿ������ͨ���⣻

2.vxlan������vlan id�������ƺͿ������ͨ���⣬ͬһʱ����gre��Ե����������������⣬ͬһʱ��ʵ���˴�2�����磬������vm�ڻ���֮��ĵ���Ǩ�ơ�

openflow

openflow��Ҫ��Ϊcontroller��flow table��������ͨ����ѭopenflowЭ�顣������controller�㣬openflow

switchֻ����flow table�趨�õĹ����������·�ɻ����Ȳ�����������ϵͳ�Ĵ��Բ�����controller��ȫ��flow

table��·�ɹ������������Ǵ�controller�õ���

Openflow�ij�����

1.������������������������룻

2.�����������������������

Openflow���⣺

1.�����������������ͻ���dz���ʵ��Ӧ��

ʵ���ҽ�ȡ������ʵ����

OVS��

�����Linux bridge��ovs�������ŵ�

1.Qos���ã��ܹ�Ϊÿ̨vm���ò�ͬ���ٶȺʹ���

2.�������

3.���ݰ�����

4.��openflow���뵽ovs�У�ʵ�ֿ���������������������롣

����Ϊֹ������gre��vxlan��openflow��ovs������������������ˣ����½���Ӧ����Щ��������neutron����ܹ���ϵ��

neutron��ϵ�ṹ���

1.Neutron Server�� �� һ���ְ����ػ�����neutron-server���ֲ��neutron-*-plugin�����Ǽ��ܹ���װ�ڿ��ƽڵ�Ҳ�ܹ���װ������ڵ㡣

neutron-server�ṩAPI�ӿڣ����Ѷ�API�ĵ��������Ѿ����úõIJ���������������������Ҫ�L�����ݿ���ά�������������ݺ���Ӧ��ϵ������·���������硢������port������IP����ȫ��ȵȡ�

2.���������Plugin Agent�������������ϵ����ݰ��Ĵ�����������Щ�����������ϵġ�����Ϊneutron-*-agent����ÿһ������ڵ������ڵ���ִ�С�һ����˵��ѡ����ʲô���������Ҫѡ���Ӧ�Ĵ�����������Neutron

Server�������Ľ�����ͨ����Ϣ������֧�֡�

3.DHCP������DHCP Agent���� ����Ϊneutron-dhcp-agent��Ϊ�����⻧�����ṩDHCP������������ڵ��ϣ��������Ҳ��ʹ����һ��������

4.3����� ��L3 Agent���� ����Ϊneutron-l3-agent��

Ϊ�ͻ����L���ⲿ�����ṩ3��ת������Ҳ����������ڵ��ϡ�

Control node��neutronserver(api/neutron-*-plugin)

Network node��neutron-*-plugin-agent/l3-agent/dhcp-agent

Computer node��neutron-*-plugin-agent |

��neutron��ϵ�У�Ӧ�����������������Linux bridge��ovs��������ʵ���ҷֱ���Linux

bridge+vxlan��ovs+vxlan�����¸����Ǵӹ����Ͻ�ȡ������ṹͼ��������������vlan���������ʵ�Ϻ�vxlan���

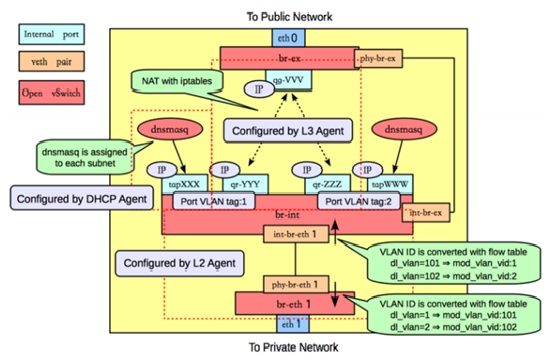

ovs+vxlan computer node and network

node

����ܹ�ͼ

�Dz��ǿ�����2��ͼ����Щ���ˣ���ô���bridge��tap�豸������ʲô�õģ�������Щ�豸��ʵ�ϲ����ѣ�redhat��ƪ����д�ĺܾ��壬��ҿ����ͺ���ȷ�ˣ�https://openstack.redhat.com/Networking_in_too_much_detail���ٷ�������ͼ��vlan���ˣ���ʵ�Ͻ���Ҫ��ͼ�е�vlan

device�ij�vxlan device���ܹ�����û��ǰ������ṹ��

��ovs�ṹ�У���������������vxlan��gre����������bridge��������br-int��br-tun(��ͼ��Ϊ��vlan������û��br-tun������br-eth1)��br-int�м������ţ������������Ϸ��ĸ����豸������vm��dhcp-agent��l3-agent����br-tun���������ţ��������ܹ���gre��Ҳ�ܹ���vxlan��br-tun������ԭʼ����������gre��vxlan����ͷ���൱������ʵ����vtep�豸(����vxlan����)��

flow table

����ֵ��һ�����network node br-tun�е�flow table����������ͼ�������ģ�����flow

table�ĸ����������ܹ���������http://mytrix.me/2014/04/dive-into-openstack-neutron-on-compute-node/�����ﲻ�����������

����ʵ���Ҵ��1��network node��2��computer node��port

1��Ӧ����ڵ��br-int��port 2��3��Ӧ2��computer node���ܹ�����������computer

node�������ݰ���port 2��3��������vlan��ǩ֮��Ҫ��ͨ����ѧϰ�Ĺ��̣���Ӧtable 10����Ȼ�������port

1��ѧϰ�Ľ������table 20��table 20��vlan id��Ŀ��vm��mac��ַ��Ϊƥ���ƥ����֮�������port

2��3��

ͨ������

ͬһ�⻧��ͬhost vm fixed ipͨ��������������ͼ�������ģ�����ͨ��fixed

ipͨ�ţ�����Ҫ����network node��ͨ��br-tun����vxlan��ǩ���ܹ�ʵ�ֲ�ͬhost�ϵ�vmͨ�š�

��ͬ�⻧��ͬhost vm floating ipͨ��������������ͼ�������ģ�������ͨ��floating

ip����ͨ�ţ���Ҫ����network node��dnat��snat��·�ɣ�ΪʲôҪͨ��network node�أ�ԭ����Ŀ��ip��ַ��floating

ip����vm2 fixed ip����һ�����Σ��������ip���Ĵ�����Ҫ�������ݸ��⻧2��Ĭ������mac4/ip4��������Ĭ�����غ���Ҫ��dnatת����Ȼ��·�ɸ��⻧1��Ĭ������mac3/ip3������snatת����������ݸ�vm1��ע������ݹ����У��������mac��ַ��ip��ַ��ת����

Linux bridge + vxlan computer node

and network node

����ovs�Ļ���������bridge�Ľṹ�ͼ��ˣ�������������rdo�bridge

+ vxlan�Ļ���ʱ�������dz������⣺

1.rdo��װlinuxbridge����Ķ�neutron_350.py

create_l3_manifests������

2.����Linuxbridge + vxlan������computer node

network node����linuxbridge_conf.ini������enable_vxlan��vxlan_group��local_ipһ��Ҫ�������ã�����bridge��vxlan�豸������ȷ�����������Ҳ��������

3.����Linuxbridge + vxlan������network node��Ҫ2��������һ��������һ��������һ������dhcp��һ������floating

ip�����L�ʣ�����DZ���ģ�������߹��ܽ�����ȡ��һ�������ڴovs����ʱ��ȴû��������⣬�dz���֣�

4.network node��Ҫ�ֹ�����һ��br-ex�����������L�ʣ�

5.�������ǣ��������ϳ�ʼ״̬��network node�ϣ���tap�豸��bridgeȫ�Ǵ���ģ���Ҫ�ֶ��Ķ���

6.��Ҫ�Ķ�vm mtuֵ������vm֮��ͨ��Ч�ʺܲ

������ʽ

���͵�������ʽ����nova-network��dhcpflat��vlan��neutron��bridge

+ vlan��bridge + vxlan��ovs + vlan��ovs + vxlan����ѡ�����ܹ���3��ά��������nova-network��neutron��ѡ����������flat��vlan��gre��vxlan��ѡ���Linux

bridge��ovs��ѡ��

nova-network��neutron��ѡ��

1.nova-network���ȶ����ṹ�������½�֧��linux bridgeһ�ֲ����

2.neutron���ܹ�֧��bridge��ovs���ڶ���������ͨ��ml2�����ܹ�ʵ���ڶ������ʹ�ã�����openflow��sdn�������ǿ�������������������롣��neutron���������������ȶ��ԣ����紴�������vm��host��������������neutron�������down����floating

ip�������ͷŵȣ���Щ�������¶��ڲ���ԭ����δ�����������iec house�汾�Ų�֧��network

muti-host���𣨾�˵juno�汾��֧�֣���������������о�һ�£�

���ۣ�δ����openstack��neutron������������ƣ�nova-network�ὥ�����滻����������δ������ȶ��Ժ�network

node ha����֮ǰ�������������ϻ�����

��������flat��vlan��gre��vxlan��ѡ��

1.flat�� ģʽ�����й㲥�籩�ķ��գ������ڴ��ģ����һǧ̨vm������

2.vlan���ܹ�����㲥�籩������Ҫ��������������chunk�ڣ�

3.gre���ܹ�����㲥�籩������Ҫ����������chunk�ڣ� ������vlan

id�������ƣ�3�����������ܹ�ʵ�ֿ�������𡣵�gre�ǵ�Ե㼼����ÿ������֮�䶼��Ҫ��һ������������4���port��Դ��һ���˷ѣ�

4.vxlan���ܹ�����㲥�籩������Ҫ����������chunk�ڣ� ������vlan

id�������ƣ�������gre��Ե����������������⣬ʵ���˴�2�����磬������vm�ڻ���֮��ĵ���Ǩ�ƣ����ڿ��������Ψһ��ȱ�����vxlan������ipͷ����С����Ҫ����vm��mtuֵ������Ч���ϻ������½���

���ۣ����費��Ҫͨ�����������ʵ�ֿ���������ܹ�ѡ��vlan�������漰�������������Ҫ������ͨ�ŷ�ʽ��ѡ��vxlan��

Linux bridge��ovs��ѡ��

�����ֲ��������ҵ��ʹ�����ģ��ǹٷ�ͳ�ƣ�ժ��http://wenku.it168.com/d_001350820.shtml��

�������ڶ���ʹ�÷ݶ��ǣ�Linux bridge31%��ovs 39%

1.Linux bridge����ʷ�ƾã��ȶ���ֵ�����������ǵ�vm�������࣬���㽻�����ֹ���ʱ������û���ر�õĶ�λ�ֶΡ�

2.ovs���ܹ����ÿһ��vm���������ơ�������ء����ݰ�������ͬһʱ���ܹ�����openflow������sdn

controller��ʹ��������������������룬����sdn controller�ܹ�ʵ��vxlan�Ŀ���������ͨ�ţ�����ҵ���ձ�����������Ǹ������⡣

���ۣ�����ovs���������⣬����Ҫ�������Ϝy�ԣ��ⲿ�ֹ�����������������ϣ�������������ָ�꣩��������δȷ��ovs�����Ƿ�ﵽ����Ҫ��֮ǰ������ʹ��Linux

bridge��

�ٷ��Ƽ���������ʽ��

ͨ������openstack�ٷ��ĵ������������bridge+vlan��ovs+vlan

˽���ƺ����Ƶ��������죺

��������vm������ʮ����������������漰�����������Ҫ�����ͨ�Ż��ơ�˽������vm����������ޣ���ǧ����������������ܹ���ÿһ��������������һ��openstack�����������ͨ�ŵ����������һЩ��

|