| БрМЭЦМі: |

БОЮФжївЊНщЩмШчКЮЪЙгУвЛИіTensorFlowЕФПЩЪгЛЏЙЄОпНјааПЩЪгЛЏЩёОЭјТчЃЌЯЃЭћЖдФњЕФбЇЯАгаЫљАяжњЁЃ

БОЮФРДздгкФЊЗГPYTHONЃЌгЩЛ№СњЙћШэМўAliceБрМЁЂЭЦМіЁЃ |

|

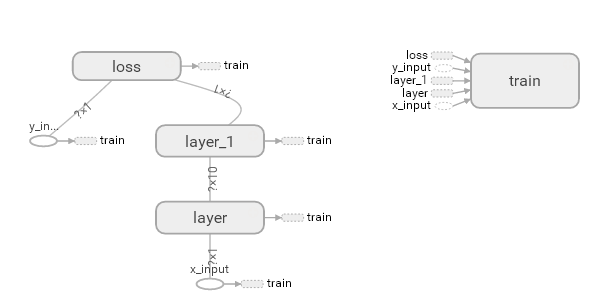

бЇЛсгУ Tensorflow здДјЕФ tensorboard ШЅПЩЪгЛЏЮвУЧЫљНЈдьГіРДЕФЩёОЭјТчЪЧвЛИіКмКУЕФбЇЯАРэНтЗНЪН.

гУзюжБЙлЕФСїГЬЭМИцЫпФуФуЕФЩёОЭјТчЪЧГЄдѕбљ,гажњгкФуЗЂЯжБрГЬжаМфЕФЮЪЬтКЭвЩЮЪ.

аЇЙћ

КУЃЌЮвУЧПЊЪМАЩЁЃ

етДЮЮвУЧЛсНщЩмШчКЮПЩЪгЛЏЩёОЭјТчЁЃвђЮЊКмЖрЪБКђЮвУЧЖМЪЧзіКУСЫвЛИіЩёОЭјТчЃЌЕЋЪЧУЛгавЛИіЭМЯёПЩвдеЙЪОИјДѓМвПДЁЃетвЛНкЛсНщЩмвЛИіTensorFlowЕФПЩЪгЛЏЙЄОп

ЁЊ tensorboard :) ЭЈЙ§ЪЙгУетИіЙЄОпЮвУЧПЩвдКмжБЙлЕФПДЕНећИіЩёОЭјТчЕФНсЙЙЁЂПђМмЁЃ вдЧАМИНкЕФДњТыЮЊР§ЃКЯрЙиДњТы

ЭЈЙ§tensorflowЕФЙЄОпДѓжТПЩвдПДЕНЃЌНёЬьвЊЯдЪОЕФЩёОЭјТчВюВЛЖрЪЧетбљзгЕФ

ЭЌЪБЮвУЧвВПЩвдеЙПЊПДУПИіlayerжаЕФвЛаЉОпЬхЕФНсЙЙЃК

КУЃЌЭЈЙ§дФЖСДњТыКЭжЎЧАЕФЭМЦЌЮвУЧДѓИХжЊЕРСЫДЫДІЪЧгавЛИіЪфШыВуЃЈinputsЃЉЃЌвЛИівўКЌВуЃЈlayerЃЉЃЌЛЙгавЛИіЪфГіВуЃЈoutputЃЉ

ЯждкПЩвдПДПДШчКЮНјааПЩЪгЛЏ.

ДюНЈЭМжН

ЪзЯШДг Input ПЊЪМЃК

# define placeholder

for inputs to network

xs = tf.placeholder(tf.float32, [None, 1])

ys = tf.placeholder(tf.float32, [None, 1]) |

ЖдгкinputЮвУЧНјааШчЯТаоИФЃК ЪзЯШЃЌПЩвдЮЊxsжИЖЈУћГЦЮЊx_in:

| xs= tf.placeholder(tf.float32,

[None, 1],name='x_in') |

ШЛКѓдйДЮЖдysжИЖЈУћГЦy_in:

| ys= tf.placeholder(tf.loat32,

[None, 1],name='y_in') |

етРяжИЖЈЕФУћГЦНЋРДЛсдкПЩЪгЛЏЕФЭМВуinputsжаЯдЪОГіРД

ЪЙгУwith tf.name_scope('inputs')ПЩвдНЋxsКЭysАќКЌНјРДЃЌаЮГЩвЛИіДѓЕФЭМВуЃЌЭМВуЕФУћзжОЭЪЧwith

tf.name_scope()ЗНЗЈРяЕФВЮЪ§ЁЃ

with tf.name_scope('inputs'):

# define placeholder for inputs to network

xs = tf.placeholder(tf.float32, [None, 1])

ys = tf.placeholder(tf.float32, [None, 1]) |

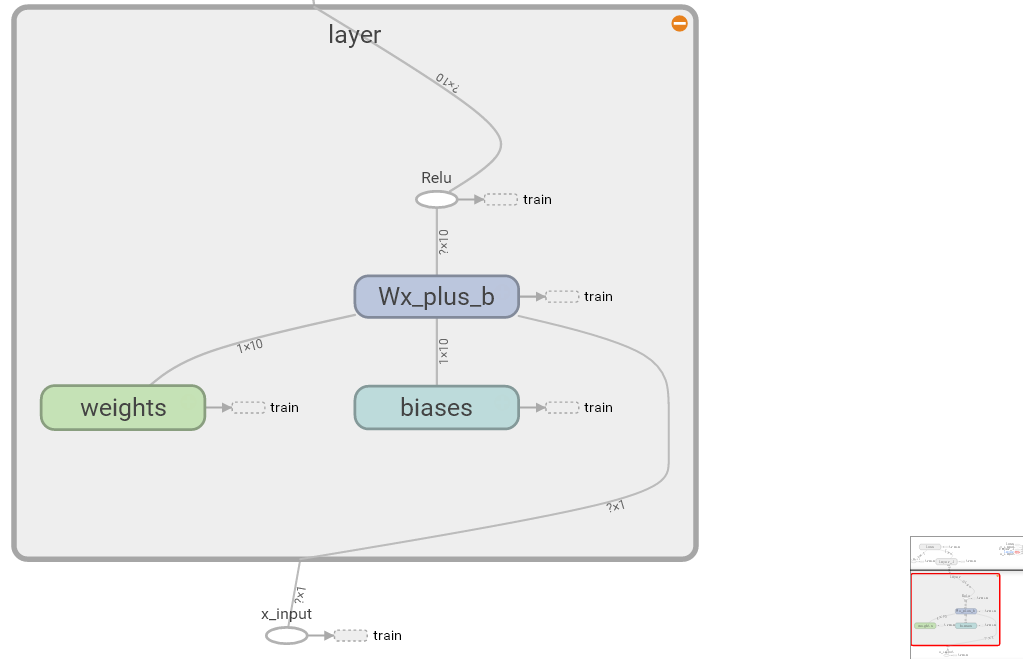

НгЯТРДПЊЪМБрМlayer ЃЌ ЧыПДБрМЧАЕФГЬађЦЌЖЮ ЃК

def add_layer(inputs,

in_size, out_size, activation_function=None):

# add one more layer and return the output of

this layer

Weights = tf.Variable(tf.random_normal([in_size,

out_size]))

biases = tf.Variable(tf.zeros([1, out_size]) +

0.1)

Wx_plus_b = tf.add(tf.matmul(inputs, Weights),

biases)

if activation_function is None:

outputs = Wx_plus_b

else:

outputs = activation_function(Wx_plus_b, )

return outputs |

етРяЕФУћзжгІИУНаlayer, ЯТУцЪЧБрМКѓЕФ:

def add_layer(inputs,

in_size, out_size, activation_function=None):

# add one more layer and return the output of

this layer

with tf.name_scope('layer'):

Weights= tf.Variable(tf.random_normal([in_size,

out_size]))

# and so on... |

дкЖЈвхЭъДѓЕФПђМмlayerжЎКѓЃЌЭЌЪБвВашвЊЖЈвхУПвЛИіЁЏПђМмЁЎРяУцЕФаЁВПМўЃК(Weights biases

КЭ activation function): ЯждкЯжЖд Weights ЖЈвхЃК ЖЈвхЕФЗНЗЈЭЌЩЯЃЌПЩвдЪЙгУtf.name.scope()ЗНЗЈЃЌЭЌЪБвВПЩвддкWeightsжажИЖЈУћГЦWЁЃ

МДЮЊЃК

def add_layer(inputs,

in_size, out_size, activation_function=None):

#define layer name

with tf.name_scope('layer'):

#define weights name

with tf.name_scope('weights'):

Weights= tf.Variable(tf.random_normal([in_size,

out_size]),name='W')

#and so on...... |

НгзХМЬајЖЈвхbiases ЃЌ ЖЈвхЗНЪНЭЌЩЯЁЃ

def add_layer(inputs,

in_size, out_size, activation_function=None):

#define layer name

with tf.name_scope('layer'):

#define weights name

with tf.name_scope('weights')

Weights= tf.Variable(tf.random_normal([in_size,

out_size]),name='W')

# define biase

with tf.name_scope('Wx_plus_b'):

Wx_plus_b = tf.add(tf.matmul(inputs, Weights),

biases)

# and so on.... |

activation_function ЕФЛАЃЌПЩвдднЪБКіТдЁЃвђЮЊЕБФуздМКбЁдёгУ

tensorflow жаЕФМЄРјКЏЪ§ЃЈactivation functionЃЉЕФЪБКђЃЌtensorflowЛсФЌШЯЬэМгУћГЦЁЃ

зюжеЃЌlayerаЮЪНШчЯТЃК

def add_layer(inputs,

in_size, out_size, activation_function=None):

# add one more layer and return the output of

this layer

with tf.name_scope('layer'):

with tf.name_scope('weights'):

Weights = tf.Variable(

tf.random_normal([in_size, out_size]),

name='W')

with tf.name_scope('biases'):

biases = tf.Variable(

tf.zeros([1, out_size]) + 0.1,

name='b')

with tf.name_scope('Wx_plus_b'):

Wx_plus_b = tf.add(

tf.matmul(inputs, Weights),

biases)

if activation_function is None:

outputs = Wx_plus_b

else:

outputs = activation_function(Wx_plus_b, )

return outputs |

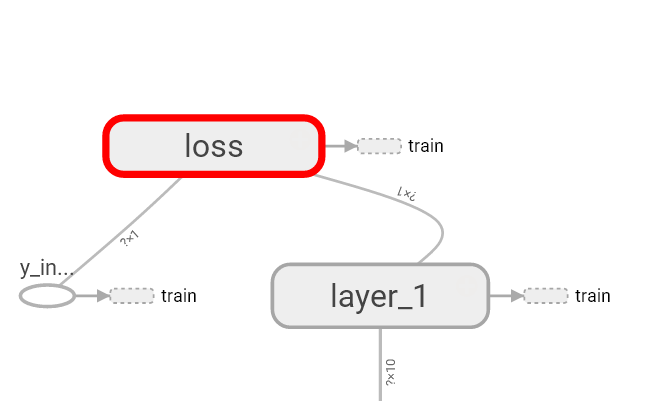

аЇЙћШчЯТЃКЃЈгаУЛгаПДМћИеВХЖЈвхlayerРяУцЕФЁАФкВПЙЙМўЁБФиЃПЃЉ

зюКѓБрМlossВПЗжЃКНЋwith tf.name_scope()ЬэМгдкlossЩЯЗНЃЌВЂЮЊЫќЦ№УћЮЊloss

# the error between

prediciton and real data

with tf.name_scope('loss'):

loss = tf.reduce_mean(

tf.reduce_sum(

tf.square(ys - prediction),

eduction_indices=[1]

)) |

етОфЛАОЭЪЧЁАЛцжЦЁБ lossСЫЃЌ ШчЯТЃК

ЪЙгУwith tf.name_scope()дйДЮЖдtrain_stepВПЗжНјааБрМ,ШчЯТЃК

with tf.name_scope('train'):

train_step = tf.train.GradientDescentOptimizer(0.1).minimize(loss) |

ЮвУЧашвЊЪЙгУ tf.summary.FileWriter() (tf.train.SummaryWriter()

етжжЗНЪНвбОдк tf >= 0.12 АцБОжао№Цњ) НЋЩЯУцЁЎЛцЛЁЏГіЕФЭМБЃДцЕНвЛИіФПТМжаЃЌвдЗНБуКѓЦкдкфЏРРЦїжаПЩвдфЏРРЁЃ

етИіЗНЗЈжаЕФЕкЖўИіВЮЪ§ашвЊЪЙгУsess.graph ЃЌ вђДЫЮвУЧашвЊАбетОфЛАЗХдкЛёШЁsessionЕФКѓУцЁЃ

етРяЕФgraphЪЧНЋЧАУцЖЈвхЕФПђМмаХЯЂЪеМЏЦ№РДЃЌШЛКѓЗХдкlogs/ФПТМЯТУцЁЃ

sess = tf.Session()

# get session

# tf.train.SummaryWriter soon be deprecated, use

following

writer = tf.summary.FileWriter("logs/",

sess.graph) |

зюКѓдкФуЕФterminalЃЈжеЖЫЃЉжа ЃЌЪЙгУвдЯТУќСю

| tensorboard --logdir

logs |

ЭЌЪБНЋжеЖЫжаЪфГіЕФЭјжЗИДжЦЕНфЏРРЦїжаЃЌБуПЩвдПДЕНжЎЧАЖЈвхЕФЪгЭМПђМмСЫЁЃ

tensorboard ЛЙгаКмЖрЦфЫћЕФВЮЪ§ЃЌЯЃЭћДѓМвПЩвдЖрЖрСЫНт, ПЩвдЪЙгУ tensorboard

--help ВщПДtensorboardЕФЯъЯИВЮЪ§ зюжеЕФШЋВПДњТыдкетРя

ПЩФмЛсгіЕНЕФЮЪЬт

(1) ЖјЧвгы tensorboard МцШнЕФфЏРРЦїЪЧ ЁАGoogle ChromeЁБ. ЪЙгУЦфЫћЕФфЏРРЦїВЛБЃжЄЫљгаФкШнЖМФме§ГЃЯдЪО.

(2) ЭЌЪБзЂвт, ШчЙћЪЙгУ http://0.0.0.0:6006 ЭјжЗДђВЛПЊЕФХѓгбУЧ, ЧыЪЙгУ

http://localhost:6006, ДѓЖрЪ§ХѓгбЖМЪЧетИіЮЪЬт.

(3) ЧыШЗБЃФуЕФ tensorboard жИСюЪЧдкФуЕФ logs

ЮФМўИљФПТМжДааЕФ. ШчЙћдкЦфЫћФПТМЯТ, БШШч Desktop ЕШ, ПЩФмВЛЛсГЩЙІПДЕНЭМ. БШШчдкЯТУцетИіФПТМ,

ФувЊ cd ЕН project етИіЕиЗНжДаа /project > tensorboard --logdir

logs

- project

- logs

model.py

env.py |

(4) ЬжТлЧјЕФХѓгбЪЙгУ anaconda ЯТЕФ python3.5 ЕФащФтЛЗОГ, ШчЙћФуЪфШы tensorboard

ЕФжИСю, ГіЯжБЈДэ: "tensorboard" is not recognized

as an internal or external command...

НтОіЗНЗЈЕФЙиМќОЭЪЧашвЊМЄЛюTensorFlow. ЙмРэдБФЃЪНДђПЊ Anaconda Prompt,

ЪфШы activate tensorflow, НгзХАДееЩЯУцЕФСїГЬжДаа tensorboard жИСю. |