| БрМЭЦМі: |

БОЮФжївЊНщЩмПЩЪгЛЏбЕСЗЙ§ГЬЕФЭМБъЪЧШчКЮзіЕФЃЌЯЃЭћЖдФњЕФбЇЯАгаЫљАяжњЁЃ

БОЮФРДздгкФЊЗГPYTHONЃЌгЩЛ№СњЙћШэМўAliceБрМЁЂЭЦМіЁЃ |

|

вЊЕу

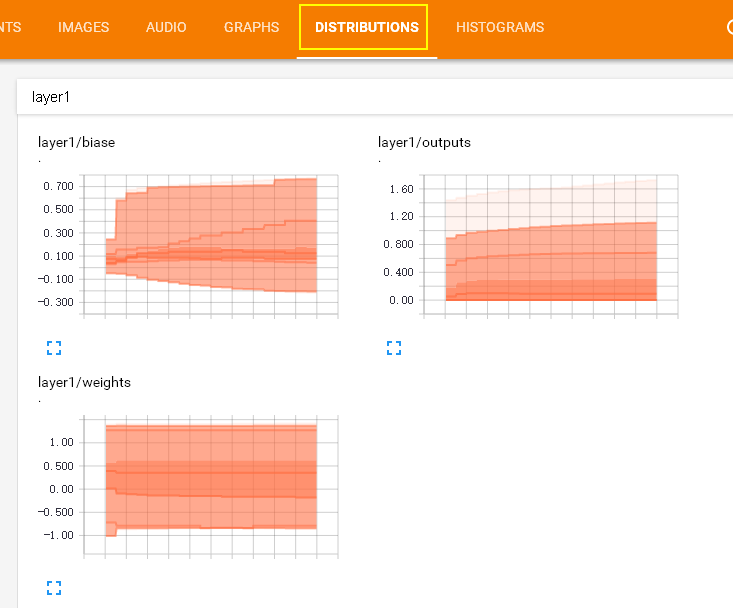

зЂвт: БОНкФкШнЛсгУЕНфЏРРЦї, ЖјЧвгы tensorboard МцШнЕФфЏРРЦїЪЧ

ЁАGoogle ChromeЁБ. ЪЙгУЦфЫћЕФфЏРРЦїВЛБЃжЄЫљгаФкШнЖМФме§ГЃЯдЪО.

ЩЯвЛЦЊНВЕНСЫ ШчКЮПЩЪгЛЏTesorBoradећИіЩёОЭјТчНсЙЙЕФЙ§ГЬЁЃ

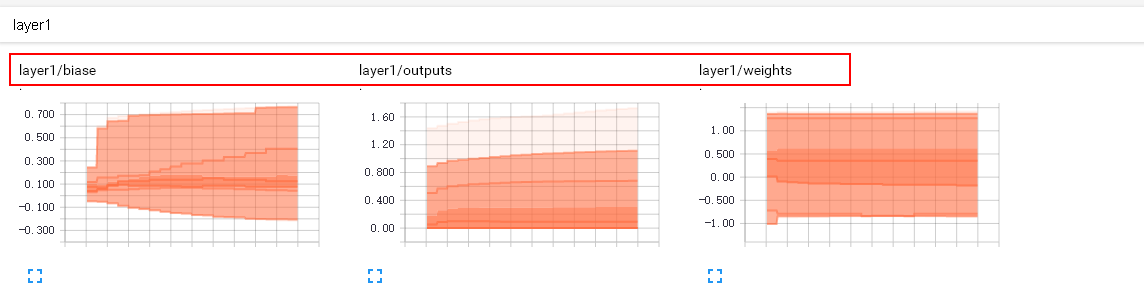

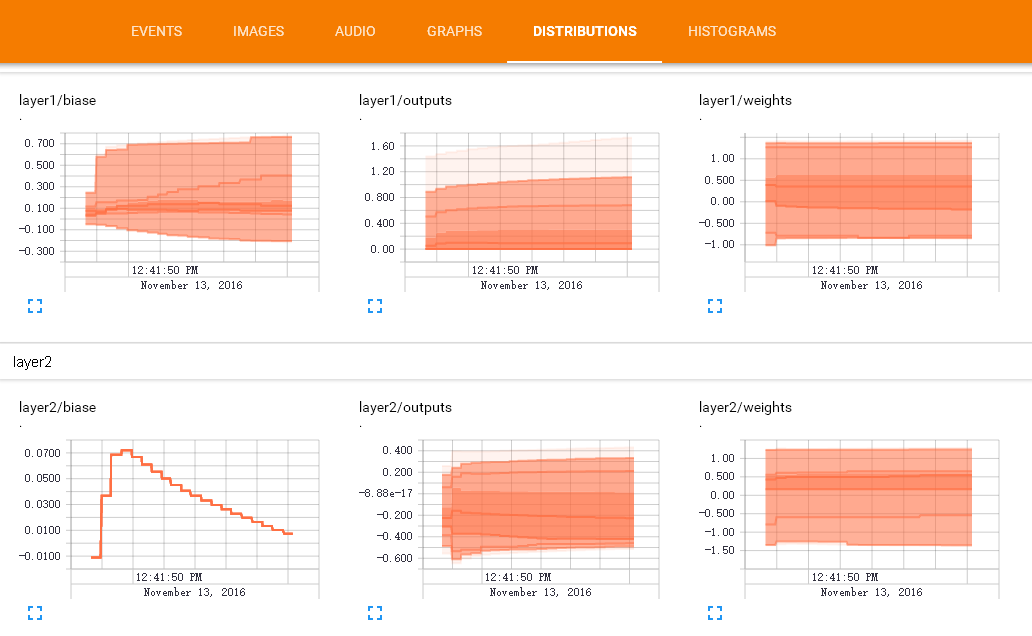

ЦфЪЕtensorboardЛЙПЩвдПЩЪгЛЏбЕСЗЙ§ГЬ( biaseБфЛЏЙ§ГЬ) , етНкжиЕуНВвЛЯТПЩЪгЛЏбЕСЗЙ§ГЬЕФЭМБъЪЧШчКЮзіЕФ

ЁЃЧыПДЯТЭМ, етЪЧШчКЮзіЕНЕФФиЃП

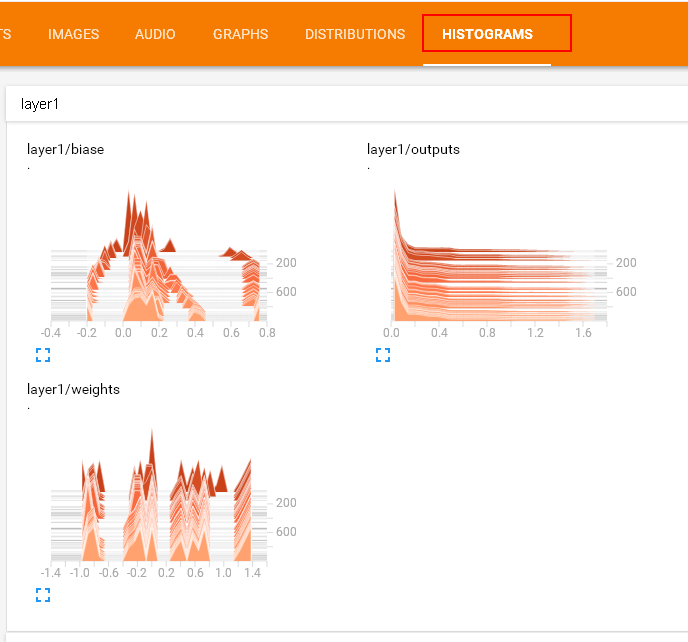

дкhistogramsРяУцЮвУЧЛЙПЩвдПДЕНИќЖрЕФlayersЕФБфЛЏ:

ЃЈP.S. ЛвУЈЪЙгУЕФ tensorflow v1.1 ЯдЪОЕФаЇЙћПЩФмКЭЪгЦЕжаЕФВЛЬЋвЛбљЃЌ

ЕЋЪЧ tensorboard ЕФЪЙгУЗНЗЈЕФЪЧвЛбљЕФЁЃЃЉ

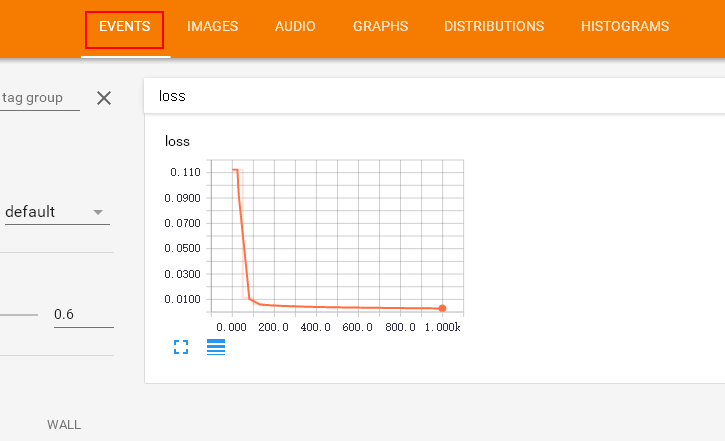

етРяЛЙгавЛИіevents , дкетДЮСЗЯАжаЮвУЧЛсАб ећИібЕСЗЙ§ГЬжаЕФЮѓВюжЕЃЈlossЃЉдкeventРяУцЯдЪОГіРД,

ЩѕжСФуПЩвдЯдЪОИќЖрФуЯывЊЯдЪОЕФЖЋЮї.

КУСЫ, ПЊЪМСЗЯААЩ, БОНкФкШнАќРЈ:

жЦзїЪфШыдД

гЩгкетНкЮвУЧЙлВьбЕСЗЙ§ГЬжаЩёОЭјТчЕФБфЛЏ, ЫљвдЪзЯШвЊЬэвЛаЉФЃФтЪ§Он.

Python ЕФ numpy ЙЄОпАќПЩвдАяжњЮвУЧжЦдьвЛаЉФЃФтЪ§Он. ЫљвдЮвУЧЯШЕМШыетИіЙЄОпАќ:

import tensorflow

as tf

import numpy as np |

ШЛКѓНшжњ np жаЕФ np.linespace() ВњЩњЫцЛњЕФЪ§зж,

ЭЌЪБЮЊСЫФЃФтИќМгецЪЕЮвУЧЛсЬэМгвЛаЉдыЩљ, етаЉдыЩљЪЧЭЈЙ§ np.random.normal() ЫцЛњВњЩњЕФ.

## make up some

data

x_data= np.linspace(-1, 1, 300, dtype=np.float32)[:,np.newaxis]

noise= np.random.normal(0, 0.05, x_data.shape).astype(np.float32)

y_data= np.square(x_data) -0.5+ noise |

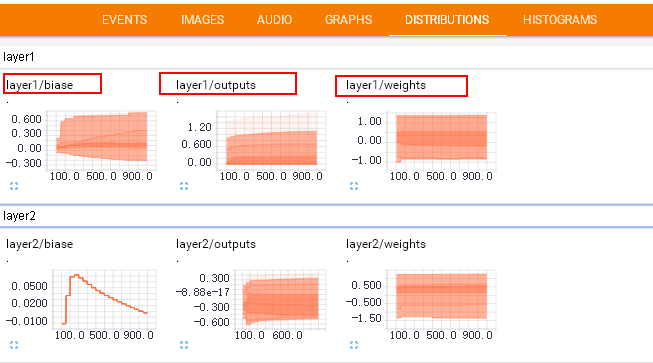

ЪфШыдДЕФЮЪЬтНтОіжЎКѓ, ЮвУЧПЊЪМжЦзїЖдWeightsКЭbiasesЕФБфЛЏЭМБэАЩ.

ЮвУЧЦкЭћПЩвдзіЕНШчЯТЕФаЇЙћ, ФЧУДЪзЯШДг layer1/weight зіЦ№АЩ

етИіаЇЙћЪЧШчКЮзіЕНЕФФи,ЧыПДЯТвЛИіБъЬт

дк layer жаЮЊ Weights, biases ЩшжУБфЛЏЭМБэ

ЭЈЙ§ЩЯЭМЕФЙлВьЮвУЧЗЂЯжУПИі layer КѓУцгагавЛИіЪ§зж: layer1

КЭlayer2

гкЪЧЮвУЧдк add_layer() ЗНЗЈжаЬэМгвЛИіВЮЪ§ n_layer,гУРДБъЪЖВуЪ§,

ВЂЧвгУБфСП layer_name ДњБэЦфУПВуЕФУћУћГЦ, ДњТыШчЯТ:

def add_layer(

inputs ,

in_size,

out_size,

n_layer,

activation_function=None):

## add one more layer and return the output of

this layer

layer_name='layer%s'%n_layer ## define a new var

## and so on ЁЁ

|

НгЯТРД,ЮвУЧВужаЕФWeightsЩшжУБфЛЏЭМ, tensorflowжаЬсЙЉСЫtf.histogram_summary()ЗНЗЈ,гУРДЛцжЦЭМЦЌ,

ЕквЛИіВЮЪ§ЪЧЭМБэЕФУћГЦ, ЕкЖўИіВЮЪ§ЪЧЭМБэвЊМЧТМЕФБфСП

def add_layer(inputs

,

in_size,

out_size,n_layer,

activation_function=None):

## add one more layer and return the output of

this layer

layer_name='layer%s'%n_layer

with tf.name_scope('layer'):

with tf.name_scope('weights'):

Weights= tf.Variable(tf.random_normal([in_size,

out_size]),name='W')

# tf.histogram_summary(layer_name+'/weights',Weights)

# tensorflow 0.12 вдЯТАцЕФ

tf.summary.histogram(layer_name + '/weights',

Weights) # tensorflow >= 0.12

##and so no ЁЁ |

ЭЌбљЕФЗНЗЈЮвУЧЖдbiasesНјааЛцжЦЭМБъ:

with tf.name_scope('biases'):

biases = tf.Variable(tf.zeros([1,out_size])+0.1,

name='b')

# tf.histogram_summary(layer_name+'/biase',biases)

# tensorflow 0.12 вдЯТАцЕФ

tf.summary.histogram(layer_name + '/biases', biases)

# Tensorflow >= 0.12 |

жСгкactivation_function ПЩвдВЛЛцжЦ. ЮвУЧЖдoutput

ЪЙгУЭЌбљЕФЗНЗЈ:

# tf.histogram_summary(layer_name+'/outputs',outputs)

# tensorflow 0.12 вдЯТАцБО

tf.summary.histogram(layer_name + '/outputs',

outputs) # Tensorflow >= 0.12 |

зюжеОЙ§ЮвУЧЕФаоИФ , addlayer()ЗНЗЈГЩЮЊШчЯТЕФбљзг:

def add_layer(inputs

,

in_size,

out_size,n_layer,

activation_function=None):

## add one more layer and return the output of

this layer

layer_name='layer%s'%n_layer

with tf.name_scope(layer_name):

with tf.name_scope('weights'):

Weights= tf.Variable(tf.random_normal([in_size,

out_size]),name='W')

# tf.histogram_summary(layer_name+'/weights',Weights)

tf.summary.histogram(layer_name + '/weights',

Weights) # tensorflow >= 0.12

with tf.name_scope('biases'):

biases = tf.Variable(tf.zeros([1,out_size])+0.1,

name='b')

# tf.histogram_summary(layer_name+'/biase',biases)

tf.summary.histogram(layer_name + '/biases',

biases) # Tensorflow >= 0.12

with tf.name_scope('Wx_plus_b'):

Wx_plus_b = tf.add(tf.matmul(inputs,Weights),

biases)

if activation_function is None:

outputs=Wx_plus_b

else:

outputs= activation_function(Wx_plus_b)

# tf.histogram_summary(layer_name+'/outputs',outputs)

tf.summary.histogram(layer_name + '/outputs',

outputs) # Tensorflow >= 0.12

return outputs |

аоИФжЎКѓЕФУћГЦЛсЯдЪОдкУПИіtensorboardжаУПИіЭМБэЕФЩЯЗНЯдЪО,

ШчЯТЭМЫљЪО:

гЩгкЮвУЧЖдaddlayer ЬэМгСЫвЛИіВЮЪ§, ЫљвдаоИФжЎЧАЕїгУaddlayer()КЏЪ§ЕФЕиЗН.

ЖдДЫДІНјаааоИФ:

# add hidden

layer

l1= add_layer(xs, 1, 10 , activation_function=tf.nn.relu)

# add output layer

prediction= add_layer(l1, 10, 1, activation_function=None) |

ЬэМгn_layerВЮЪ§Кѓ, аоИФГЩЮЊ :

# add hidden

layer

l1= add_layer(xs, 1, 10, n_layer=1, activation_function=tf.nn.relu)

# add output layer

prediction= add_layer(l1, 10, 1, n_layer=2, activation_function=None) |

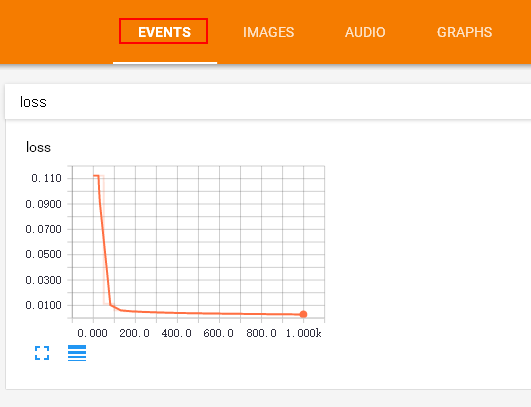

ЩшжУlossЕФБфЛЏЭМ

Loss ЕФБфЛЏЭМКЭжЎЧАЩшжУЕФЗНЗЈТдгаВЛЭЌ. lossЪЧдкtesnorBorad

ЕФeventЯТУцЕФ, етЪЧгЩгкЮвУЧЪЙгУЕФЪЧtf.scalar_summary() ЗНЗЈ.

ЙлПДlossЕФБфЛЏБШНЯживЊ. ЕБФуЕФlossГЪЯТНЕЕФЧїЪЦ,ЫЕУїФуЕФЩёОЭјТчбЕСЗЪЧгааЇЙћЕФ.

аоИФКѓЕФДњТыЦЌЖЮШчЯТЃК

# add hidden

layer

l1= add_layer(xs, 1, 10, n_layer=1, activation_function=tf.nn.relu)

# add output layer

prediction= add_layer(l1, 10, 1, n_layer=2, activation_function=None) |

ИјЫљгабЕСЗЭМКЯВЂ

НгЯТРДЃЌ ПЊЪМКЯВЂДђАќЁЃ tf.merge_all_summaries()

ЗНЗЈЛсЖдЮвУЧЫљгаЕФ summaries КЯВЂЕНвЛЦ№. вђДЫдкдгаДњТыЦЌЖЮжаЬэМгЃК

| sess= tf.Session()

# merged= tf.merge_all_summaries() # tensorflow

< 0.12

merged = tf.summary.merge_all() # tensorflow

>= 0.12

# writer = tf.train.SummaryWriter('logs/',

sess.graph) # tensorflow < 0.12

writer = tf.summary.FileWriter("logs/",

sess.graph) # tensorflow >=0.12

# sess.run(tf.initialize_all_variables()) #

tf.initialize_all_variables() # tf ТэЩЯОЭвЊЗЯЦњетжжаДЗЈ

sess.run(tf.global_variables_initializer())

# ЬцЛЛГЩетбљОЭКУ |

бЕСЗЪ§Он

МйЖЈИјГіСЫx_data,y_dataВЂЧвбЕСЗ1000ДЮ.

for i in range(1000):

sess.run(train_step, feed_dict={xs:x_data, ys:y_data}) |

вдЩЯетаЉНіНіПЩвдМЧТМКмЛцжЦГібЕСЗЕФЭМБэЃЌ ЕЋЪЧВЛЛсМЧТМбЕСЗЕФЪ§ОнЁЃ

ЮЊСЫНЯЮЊжБЙлЯдЪОбЕСЗЙ§ГЬжаУПИіВЮЪ§ЕФБфЛЏЃЌЮвУЧУПИєЩЯ50ДЮОЭМЧТМвЛДЮНсЙћ , ЭЌЪБЮвУЧвВгІзЂвт, merged

вВЪЧашвЊrun ВХФмЗЂЛгзїгУЕФ,ЫљвддкforбЛЗжааДЯТЃК

if i%50 == 0:

rs = sess.run(merged,feed_dict={xs:x_data,ys:y_data})

writer.add_summary(rs, i) |

зюКѓаоИФКѓЕФЦЌЖЮШчЯТЃК

for i in range(1000):

sess.run(train_step, feed_dict={xs:x_data, ys:y_data})

if i%50 == 0:

rs = sess.run(merged,feed_dict={xs:x_data,ys:y_data})

writer.add_summary(rs, i) |

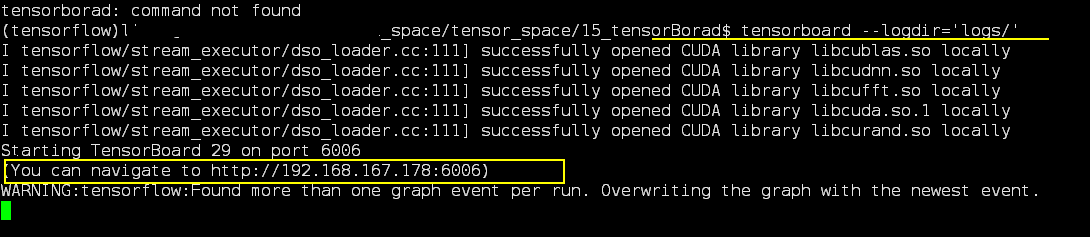

дк tensorboard жаВщПДаЇЙћ

ГЬађдЫааЭъБЯжЎКѓ, ЛсВњЩњlogsФПТМ , ЪЙгУУќСю tensorboard

--logdir logs

зЂвт: БОНкФкШнЛсгУЕНфЏРРЦї, ЖјЧвгы tensorboard МцШнЕФфЏРРЦїЪЧ

ЁАGoogle ChromeЁБ. ЪЙгУЦфЫћЕФфЏРРЦїВЛБЃжЄЫљгаФкШнЖМФме§ГЃЯдЪО.

ЭЌЪБзЂвт, ШчЙћЪЙгУ http://0.0.0.0:6006 Лђеп

tensorboard жаЯдЪОЕФЭјжЗДђВЛПЊЕФХѓгбУЧ, ЧыЪЙгУ http://localhost:6006,

ДѓЖрЪ§ХѓгбЖМЪЧетИіЮЪЬт.

ЛсгаШчЯТЪфГі:

НЋЪфГіжаЯдЪОЕФURLЕижЗеГЬљЕНфЏРРЦїжаБуПЩвдВщПД. зюжеЕФаЇЙћШчЯТ:

|